解釋機器學習中的回歸與分類

已發表: 2022-12-19回歸和分類是機器學習中最基本和最重要的兩個領域。

當您剛剛接觸機器學習時,區分回歸和分類算法可能很棘手。 了解這些算法的工作原理以及何時使用它們對於做出準確的預測和有效的決策至關重要。

首先,讓我們看看機器學習。

什麼是機器學習?

機器學習是一種在沒有明確編程的情況下教計算機學習和做出決策的方法。 它涉及在數據集上訓練計算機模型,允許模型根據數據中的模式和關係做出預測或決策。

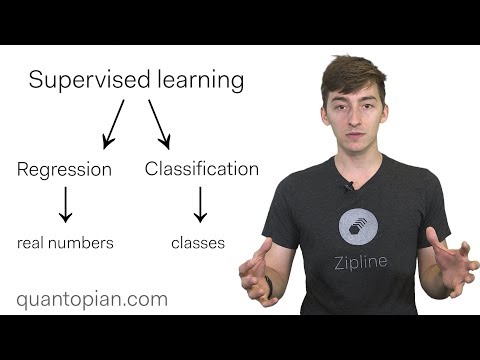

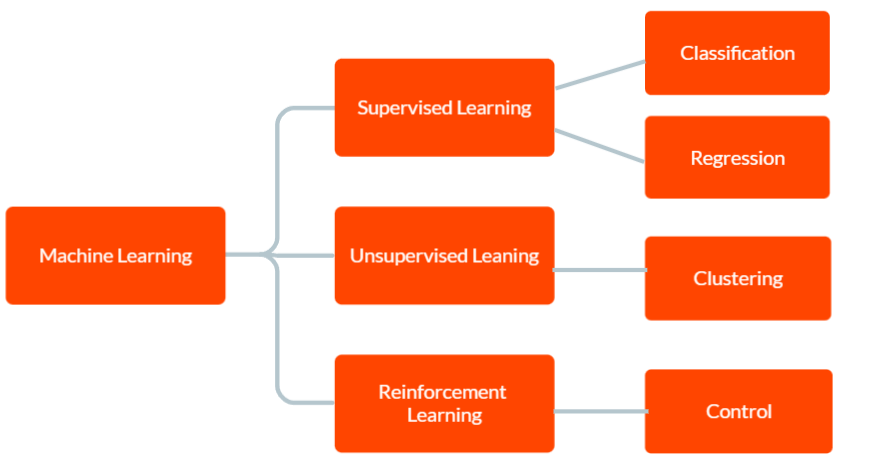

機器學習主要分為三種類型:監督學習、非監督學習和強化學習。

在監督學習中,模型被提供有標記的訓練數據,包括輸入數據和相應的正確輸出。 目標是讓模型根據從訓練數據中學到的模式預測新的、未見過的數據的輸出。

在Unsupervised learning中,模型沒有給出任何標記的訓練數據。 相反,它需要獨立發現數據中的模式和關係。 這可用於識別數據中的組或集群,或查找異常或不尋常的模式。

在強化學習中,代理學習與其環境交互以最大化獎勵。 它涉及訓練模型根據從環境中收到的反饋做出決策。

機器學習用於各種應用,包括圖像和語音識別、自然語言處理、欺詐檢測和自動駕駛汽車。 它有可能使許多任務自動化並改善各個行業的決策制定。

本文主要關注監督機器學習下的分類和回歸概念。 讓我們開始吧!

機器學習中的分類

分類是一種機器學習技術,涉及訓練模型為給定輸入分配類別標籤。 這是一項有監督的學習任務,這意味著模型是在標記的數據集上訓練的,該數據集包括輸入數據的示例和相應的類標籤。

該模型旨在學習輸入數據和類標籤之間的關係,以預測新的、未見過的輸入的類標籤。

有許多不同的算法可用於分類,包括邏輯回歸、決策樹和支持向量機。 算法的選擇將取決於數據的特徵和模型的期望性能。

一些常見的分類應用包括垃圾郵件檢測、情緒分析和欺詐檢測。 在每一種情況下,輸入數據都可能包括文本、數值或兩者的組合。 類別標籤可以是二元的(例如,垃圾郵件或非垃圾郵件)或多類別的(例如,正面、中性、負面情緒)。

例如,考慮一個產品的客戶評論數據集。 輸入數據可能是評論的文本,類別標籤可能是評級(例如,正面、中性、負面)。 該模型將在標記評論的數據集上進行訓練,然後能夠預測它以前從未見過的新評論的評級。

ML 分類算法類型

機器學習中有幾種類型的分類算法:

邏輯回歸

這是用於二元分類的線性模型。 它用於預測某個事件發生的概率。 邏輯回歸的目標是找到最小化預測概率和觀察結果之間誤差的最佳係數(權重)。

這是通過使用優化算法(例如梯度下降)來調整係數,直到模型盡可能地適合訓練數據來完成的。

決策樹

這些是基於特徵值做出決策的樹狀模型。 它們可用於二分類和多分類。 決策樹有幾個優點,包括它們的簡單性和互操作性。

它們的訓練和預測速度也很快,並且可以處理數字和分類數據。 但是,它們可能容易過度擬合,尤其是當樹很深且有很多分支時。

隨機森林分類

隨機森林分類是一種集成方法,將多個決策樹的預測結合起來,做出更準確、更穩定的預測。 它比單個決策樹更不容易過度擬合,因為對單個決策樹的預測進行了平均,從而減少了模型中的方差。

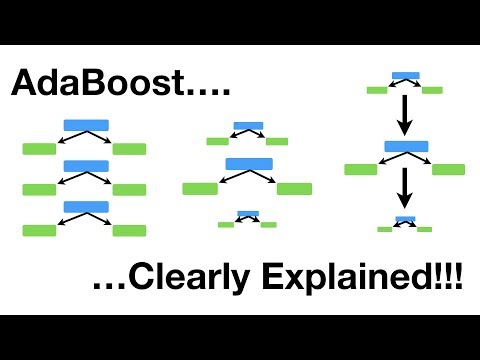

AdaBoost

這是一種提升算法,可以自適應地改變訓練集中錯誤分類示例的權重。 它通常用於二進制分類。

樸素貝葉斯

樸素貝葉斯基於貝葉斯定理,這是一種根據新證據更新事件概率的方法。 它是一種概率分類器,通常用於文本分類和垃圾郵件過濾。

K-最近鄰

K 最近鄰 (KNN) 用於分類和回歸任務。 它是一種非參數方法,根據最近鄰居的類別對數據點進行分類。 KNN 有幾個優點,包括它的簡單性和易於實現的事實。 它還可以處理數值和分類數據,並且不對基礎數據分佈做出任何假設。

梯度提升

這些是按順序訓練的弱學習器的集合,每個模型都試圖糾正前一個模型的錯誤。 它們可用於分類和回歸。

機器學習中的回歸

在機器學習中,回歸是一種監督學習,其目標是根據一個或多個輸入特徵(也稱為預測變量或自變量)預測 ac 因變量。

回歸算法用於對輸入和輸出之間的關係建模,並根據該關係進行預測。 回歸可用於連續和分類因變量。

一般來說,回歸的目標是建立一個模型,可以根據輸入特徵準確預測輸出,並理解輸入特徵和輸出之間的潛在關係。

回歸分析用於各種領域,包括經濟學、金融學、市場營銷和心理學,以理解和預測不同變量之間的關係。 它是數據分析和機器學習的基本工具,用於進行預測、識別趨勢和了解驅動數據的潛在機制。

例如,在一個簡單的線性回歸模型中,目標可能是根據房屋的大小、位置和其他特徵來預測房屋的價格。 房子的大小和位置是自變量,而房子的價格是因變量。

該模型將根據輸入數據進行訓練,這些數據包括幾所房屋的大小和位置,以及相應的價格。 一旦模型經過訓練,就可以根據房屋的大小和位置來預測房屋的價格。

機器學習回歸算法類型

回歸算法有多種形式,每種算法的使用取決於參數的數量,例如屬性值的種類、趨勢線的模式和自變量的數量。 經常使用的回歸技術包括:

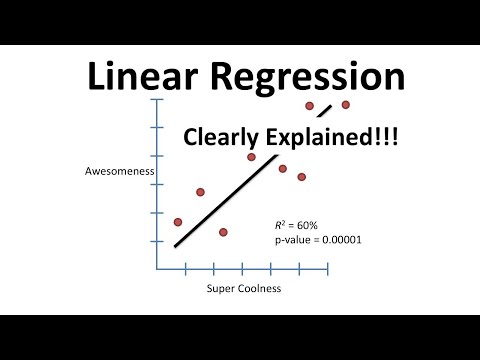

線性回歸

這個簡單的線性模型用於根據一組特徵預測連續值。 它用於通過對數據擬合一條線來對特徵與目標變量之間的關係進行建模。

多項式回歸

這是一個非線性模型,用於將曲線擬合到數據。 當關係不是線性時,它用於對特徵和目標變量之間的關係建模。 它基於向線性模型添加高階項以捕獲因變量和自變量之間的非線性關係的想法。

嶺回歸

這是一個解決線性回歸中過度擬合問題的線性模型。 它是線性回歸的正則化版本,向成本函數添加懲罰項以降低模型的複雜性。

支持向量回歸

與 SVM 一樣,支持向量回歸是一種線性模型,它試圖通過找到最大化因變量和自變量之間的差值的超平面來擬合數據。

然而,與用於分類的 SVM 不同,SVR 用於回歸任務,其目標是預測連續值而不是類別標籤。

套索回歸

這是另一個正則化線性模型,用於防止線性回歸中的過度擬合。 它根據係數的絕對值向成本函數添加懲罰項。

貝葉斯線性回歸

貝葉斯線性回歸是一種基於貝葉斯定理的線性回歸的概率方法,它是一種根據新證據更新事件概率的方法。

該回歸模型旨在估計給定數據的模型參數的後驗分佈。 這是通過定義參數的先驗分佈,然後使用貝葉斯定理根據觀察到的數據更新分佈來完成的。

回歸與分類

回歸和分類是監督學習的兩種類型,這意味著它們用於根據一組輸入特徵來預測輸出。 但是,兩者之間存在一些關鍵差異:

| 回歸 | 分類 | |

| 定義 | 一種預測連續值的監督學習 | 一種預測分類值的監督學習 |

| 輸出類型 | 連續的 | 離散的 |

| 評價指標 | 均方誤差(MSE)、均方根誤差(RMSE) | 準確率、精確率、召回率、F1 分數 |

| 算法 | 線性回歸、Lasso、Ridge、KNN、決策樹 | 邏輯回歸、SVM、樸素貝葉斯、KNN、決策樹 |

| 模型複雜度 | 不太複雜的模型 | 更複雜的模型 |

| 假設 | 特徵和目標之間的線性關係 | 沒有關於特徵和目標之間關係的特定假設 |

| 階級失衡 | 不適用 | 這可能是個問題 |

| 異常值 | 會影響模型的性能 | 通常不是問題 |

| 特徵重要性 | 功能按重要性排序 | 特徵不按重要性排序 |

| 示例應用程序 | 預測價格、溫度、數量 | 預測是否是垃圾郵件,預測客戶流失 |

學習資源

選擇最好的在線資源來理解機器學習概念可能具有挑戰性。 我們檢查了可靠平台提供的熱門課程,向您推薦了有關回歸和分類的頂級 ML 課程。

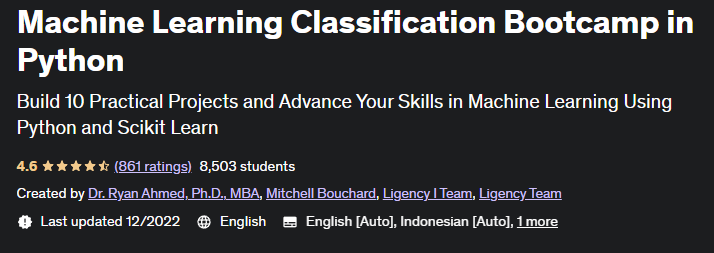

#1。 Python 機器學習分類訓練營

這是 Udemy 平台上提供的課程。 它涵蓋了多種分類算法和技術,包括決策樹和邏輯回歸,並支持向量機。

您還可以了解諸如過度擬合、偏差-方差權衡和模型評估等主題。 本課程使用 sci-kit-learn 和 pandas 等 Python 庫來實現和評估機器學習模型。 因此,開始本課程需要基本的 Python 知識。

#2。 Python 機器學習回歸大師班

在此 Udemy 課程中,培訓師涵蓋了各種回歸算法的基礎知識和基礎理論,包括線性回歸、多項式回歸以及套索和嶺回歸技術。

在本課程結束時,您將能夠實施回歸算法並使用各種關鍵性能指標評估經過訓練的機器學習模型的性能。

包起來

機器學習算法在許多應用程序中都非常有用,它們可以幫助自動化和簡化許多流程。 機器學習算法使用統計技術來學習數據中的模式,並根據這些模式做出預測或決策。

它們可以接受大量數據的訓練,並可用於執行人類手動完成的困難或耗時的任務。

每種 ML 算法都有其優點和缺點,算法的選擇取決於數據的性質和任務的要求。 為您要解決的特定問題選擇合適的算法或算法組合很重要。

為您的問題選擇正確類型的算法很重要,因為使用錯誤類型的算法會導致性能不佳和預測不准確。 如果您不確定要使用哪種算法,嘗試回歸和分類算法並比較它們在您的數據集上的性能會很有幫助。

我希望你發現這篇文章有助於學習機器學習中的回歸與分類。 您可能也有興趣了解頂級機器學習模型。