行銷人員對 ChatGPT 和人工智慧行銷應用的看法

已發表: 2023-09-22人工智慧是一種快速發展且複雜的現象。 企業想知道像 ChatGPT 這樣的人工智慧工具是否值得他們關注,還是只是曇花一現。

最近幾個月,你們中的許多人都嘗試過人工智慧工具。 我們也一直在對它們進行測試。 今天,我們探討了這項實驗的結果以及我們對人工智慧的看法,特別是人工智慧在行銷中的應用。

以下是本文涵蓋的主題:

- 人工智慧發展的極客時間表

- AI 和 ChatGPT 的風險

- 人工智慧在行銷的應用

- 人工智慧做不到的事,人類卻可以

- 人類與人工智慧如何相處

本文基於我們的一場熱門網路研討會。 觀看影片並下載幻燈片。

一堂極客歷史課

早在六十年代中期,Joseph Weizenbaum 就寫了一個名為 Eliza 的聊天機器人。 它以一種非常粗略的方式模擬了你可能與心理治療師進行的對話。 他的一位同事要求他離開房間,以便她可以與電腦治療師進行私人對話,這讓他感到震驚。 現在在我們看來,這並不是特別令人信服,但在當時,這確實是一種文化現象(你們中的一些人可能還記得!)。

然後,在七十年代中期,出現了 Zork——一款文字冒險遊戲,你可以在其中輸入你的答案並告訴它該做什麼。 再說一次,雖然不是很有說服力,但目前仍然是人工智慧或「模擬人工智慧」的令人興奮的使用。

現在,到了八十年代。 確切地說是1984年。 《警察的鬍子是半成品》是第一本由電腦寫的書。

它是由一個名為 Racter 的可以寫詩的程式編寫的。 這不是一首偉大的詩,但也不可怕。

「除了鐵、鉛、黃金之外,我還需要電力。 我需要它比需要羊肉、豬肉、生菜或黃瓜還要多。 我需要它來實現我的夢想。

40 年後(我們認為),OpenAI 的 ChatGPT 在拼韻方面只稍微好一點。

今天和明天

讓我們快轉四十年到今天。 現在,人們對 ChatGPT 和生成式大型語言模型進行了大量的炒作。 人類的聰明才智、人類的能力以及人類對電腦做這類事情的渴望,讓我們對它的實際情況有些視而不見。

科林鮑威爾說:“永遠不要相信你聽到的第一件事。” 我們擁有的是隨機鸚鵡,它們使用大量數據和機器學習來做有趣的事情。 不是超級智慧的人工智慧機器能夠滿足我們的每一個需求,推動社會超越稀缺,走向富裕,就像伊恩·M·班克斯(Ian M. Banks)一樣。

事實上,許多人工智慧炒作都是行銷,其目的是推動或捍衛大公司的股價。 所以每個人都在建構類似的系統。 微軟的CoPilot、Google的Bard、Meta的Llama。 他們希望被視為處於技術創新的前沿。 他們想要分一杯羹。

事實上,現在判斷其全部影響和影響還為時過早。 毛主席會見亨利·基辛格,基辛格問:“你認為法國大革命的影響是什麼?” 毛澤東說:“現在下結論還為時過早。” 30 多年來,我們仍然經歷著網路革命的影響。大多數技術變革在短期內都被高估,而長期來看則被低估。 對於人工智慧也是如此。

尼古拉斯·卡爾 (Nicholas Carr) 認為谷歌讓我們變得愚蠢,他說:“這並不重要。” 如果每個人都擁有個人電腦(這是一個很大的「如果」。「未來已經到來- 只是分佈不均勻。」——威廉·吉布森),那麼擁有個人電腦對生產力、策略或競爭優勢沒有任何影響。 當然,如果不使用 IT,您就會處於不利地位。 Excel已經牢牢擊敗了算盤和鉛筆。 因此,其中一些人工智慧工具將成為籌碼。 您需要使用它們來保持競爭力,但它們本身並不會為您帶來競爭優勢。

都說了。 讓我們談談行銷背景下的人工智慧。

去年發生了什麼變化?

首先,ChatGPT-4(特別是)很有用。 HubSpot 對 1,300 名行銷人員進行了研究,其中許多人已經定期使用 ChatGPT 進行研究、產生想法並創建內容。 稍後會詳細介紹這一點。

第二個變化是它被內建到很多很多工具。 它無所不在。 您會發現它出現在各種行銷和專案管理應用程式和工具中,例如 Notion、ClickUp、Grammarly、聊天機器人。 每個企業都是人工智慧企業。 每個應用程式都是人工智慧應用程式。

第三件事是價格改變了。 多年來,廉價一直是行銷的一種選擇。 您每月可以在 Fiverr 或 Copify 或 Guru 上購買數十篇部落格文章。 您的聲譽和搜尋引擎優化存在風險,但選擇一直存在。 那不是改變的地方。 改變的是,有了人工智慧,你只需幾便士而不是英鎊就能獲得幾十個部落格。 這是一個很大的區別。 但要再次小心。 危險。 警告。

人工智慧的理論風險

這些風險屬於「有趣,但你對此無能為力」的風險。 人們喜歡談論更多的投機風險,但幾乎沒有立即實際的解決方案。

1.人工智慧是不道德的

「ChatGPT 及其兄弟本質上無法平衡創造力與約束。 他們要麼過度生成(產生真理和謊言,支持道德和不道德的決定),要麼生成不足(表現出對任何決定不承諾和對後果漠不關心)。

— Noam Chomsky:ChatGPT 的虛假承諾,《紐約時報》

2.人工智慧缺乏創造力

“ChatGPT 是網路上的模糊 JPG。”

——特德·蔣(Ted Jiang),同名文章,《紐約客》

“像 ChatGPT 這樣的系統不是創造,而是模仿。”

— Cal Newport,《ChatGPT 有什麼樣的想法?》,《紐約客》

“人工智慧,特別是法學碩士,是一隻隨機鸚鵡。”

— Emily M. Bender 等人,論隨機鸚鵡的危險:語言模型會太大嗎?,艾倫圖靈研究所

當然,雖然你可以說 ChatGPT 沒有那麼有創意,但你也可以對許多行銷人員和行銷機構說同樣的話……基本上,每個人都有自己的觀點,這更像是一個需要解決的有形主題。從某種意義上說,所以我們將在接下來的幾節中詳細討論這一點。

4.人工智慧將引發就業末日

「百分之八十的美國勞動力的工作相關任務至少有百分之十受到語言模型的影響。 五分之一的人認為至少一半的日常任務受到人工智慧的影響。

— Felton、Raj 和 Seamans,接觸生成人工智慧的職業異質性

順便說一句,你可以使用他們的互動式工具來檢查你的工作將如何受到人工智慧的影響。 行銷人員和商業領袖肯定會看到一些影響。

5.人工智慧將引發真正的世界末日

“自原子彈以來,沒有任何技術能像人工智慧那樣激發世界末日的想像力。”

——羅斯安德森,《永遠不要給人工智慧核密碼》,《大西洋月刊》

人工智慧的實際風險

作為行銷人員,您需要意識到有關 AI 和 ChatGPT 的一些真實的事情。 這是你現在關心的事情,你應該注意。

1.人工智慧已經過時了

ChatGPT 自己也承認,“對 2021 年後的世界和事件的了解有限”,因為那是它進行資料處理的時間。

2.人工智慧是不安全的(不是那樣的)

這直接來自他們的網站:「我們的人工智慧培訓師可能會審查對話」。 如果您擔心機密性、隱私和 GDPR 合規性,這是一個嚴重的、合法的風險。

3.人工智慧產生幻覺

如果你依賴它進行研究,它產生幻覺的事實是一個嚴重的問題。 它將編造聽起來真實但實際上並不存在的統計數據、來源和引述。 經常檢查你的消息來源。 透過詢問 ChatGPT 您是誰來測試這一點。 (我問「馬修·斯蒂比是誰?」我收到的簡歷充滿了錯誤。)

4.人工智慧自我審查

ChatGPT 3.5 因為沒有審查而遇到了很多麻煩,所以這個版本非常有PG性。 這是一個令人擔憂的問題,因為如果它在某些方面進行自我審查,那麼它還有什麼沒有告訴你呢? 哪些偏見可能會影響過濾?

5.人工智慧會危及你的聲譽

可以從四個角度來看這個問題:

- 加浮水印:這是指您定位為自己的思想領袖的內容被發現是由 ChatGPT 編寫的。 這使得你作為「專家」的地位無效。

- 錯誤:這是指 ChatGPT 引用錯誤的內容(幻覺),而您認為它是準確的。 有一個案例,兩名律師向法庭提交了一份案情陳述,並援引了自己的辯護案例,而這些陳述完全是ChatGPT編造的。 它適得其反,大規模的。

- 剽竊:偷竊顯然是錯的。 但如果人工智慧使用受版權保護的材料進行訓練,會發生什麼事? 您可能有因抄襲而受到處罰的風險。

- 不真實性:想像一下,您作為執行長給業務合作夥伴或客戶寫了一封私人信件,他們發現這只是 ChatGPT 的談話。 這對你們的關係非常有害。

6.人工智慧增加了噪音,但並沒有消除噪音

如果您的行銷策略依賴大量廉價、低品質的內容,那麼您將面臨更多的競爭。 而且,這樣說來,這聽起來也不是一個很好的策略? 更不用說谷歌正在優化其演算法來檢測虛假內容。 您需要將自己定位為真正的思想領袖,以區別於競爭對手。

7. 人工智慧(太)容易依賴

把這想像成肌肉萎縮。 如果你依靠人工智慧來為你思考,你就會失去生活和行銷中真正重要的技能,例如來源批評和邏輯思維。

人工智慧在行銷的應用

消除所有這些風險後,讓我們看看機會。 這些是我們認為值得嘗試的使用人工智慧進行行銷的方法。

1. 少起草,多打磨

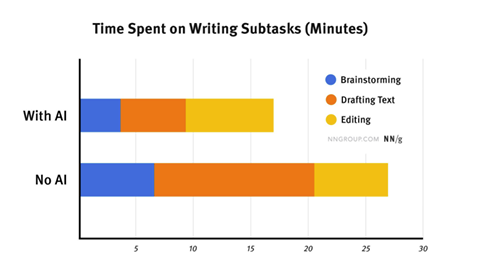

諾曼爾森小組發現,在商業環境中,使用人工智慧的專業人士花在起草文字上的時間更少,而花在編輯上的時間更多。 因此,他們將更多的時間花在能夠產生更高品質工作的事情上,而將更少的時間花在苦差事上。 你可以花同樣多的時間做某件事,但將更多的時間投入到高價值、高回報的活動上,例如研究、建構、編輯和改進。

2.簡化寫作瑣事

有些寫作任務平淡無奇且耗時。 摘要。 元描述。 社群媒體貼文(在某種程度上)。 問卷調查。 您可以對副本進行一些調整和編輯,但擁有人工智慧有助於解決大部分工作。

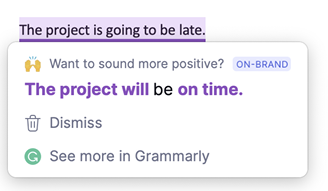

3.調整語氣

使用ChatGPT和AI工具來調整文案的基調。 電子郵件,尤其如此。 如果您想確保您的電子郵件具有品牌特色並且不會顯得過於生硬或其他什麼,人工智慧可以幫助您實現這一目標。 不過,在發送之前請務必先查看電子郵件!

4. 獲得一個有創意的助手

我們要求五個頭韻詞來解釋為什麼行銷人員可能希望避免使用 ChatGPT。 它提出了非個人化的、不準確的、不一致的、麻木不仁的和不靈活的。 偉大的。 現在我們可能不一定會使用它建議的其餘部分,但所有作家都喜歡頭韻,而人工智慧將讓你免於字母表的痛苦。

另外,您也可以使用它來連接句子來橋接段落,或為 ledes 或 kickers 提供有趣的單字選擇建議。 它的詞彙量很大,因此請使用它。

5. 記錄會議記錄和行動項目

透過 Microsoft Teams,可以輕鬆獲得會議的完整記錄。 但這可能需要篩選大量文字。 然後,人工智慧可以在幾秒鐘內從記錄中提取要點和行動項目的準確摘要。

人類能做的事(人工智慧不能做的事)

讓我們看看硬幣的另一面,這是人工智慧無法做到的。 哦,至少,在這方面它需要更多的次要地位。

EEAT

谷歌在這整個領域的經驗、專業知識、權威和可信度。 如果這些是 SEO 的優先事項,ChatGPT 將無法滿足這個標準。

精神領袖

同樣,如果你想做思想領導,你需要與眾不同。 你需要聽起來與眾不同。 你需要一些個性、一些觀點、一些真實的經驗、一些原創性、一些嘶嘶聲和薑味。 AI不可能是你。 思想領導力是高品質行銷和文案發揮非常重要作用的領域。

講故事和懸念

非小說類寫作和新聞報道有說故事的技巧。 看看唐納德·莫瑞(Donald Murray)的《寫到最後期限》。 「控制懸念」是著名記者兼廣播員阿利斯泰爾·庫克(Alistair Cooke)用過的一句話。 這些都是優秀寫作的核心,而人工智慧在這些方面做得併不好。

深刻理解

《紐約客》不會使用 ChatGPT 來撰寫文章。 這就是為什麼。 任何需要超越最膚淺或一般水平深入了解客戶或您的業務、產品或客戶的事情都需要人性化。 人工智慧無法進行原創性研究,也無法採訪人們。

超越平淡無奇

人工智慧寫作就像麥當勞。 廣告裡看起來不錯; 嘗起來像紙板。 有點沉悶。 乏味。 它可能通過了圖靈測試,但它不是艾倫圖靈。 任何需要平淡無奇的東西的寫作,例如產品命名、標語、高影響力的網站文案、特定品牌的文案、標題……它們都需要人類的想像。

人工智慧作為您的個人自動駕駛儀

微軟談副駕駛。 LinkedIn 的創辦人里德霍夫曼(Reid Hoffman)寫了一本關於人工智慧的書,他將其視為本科生研究助理或相當聰明的實習生。 史蒂夫‧賈伯斯說「電腦就像心靈的自行車」——人類力量的促進劑。 道格·恩格爾巴特 (Doug Engelbart) 談論的是智慧增強 (IA),而不是人工智慧 (AI)。 我們喜歡這個主意。

為了添加我們自己的比喻,我們將人工智慧視為自動駕駛儀。 它可以駕駛飛機並做一些非常聰明的事情。 但它無法選擇要去哪裡。 它無法使用自己的判斷,也不具備作為飛行員的專業知識、經驗和判斷程度。 但它使飛行更加安全,因為它釋放了飛行員的頻寬。 事實上,英國航空公司不會讓你在惡劣天氣下在不使用自動駕駛儀的情況下著陸。

我們有責任接受這項技術,並以安全、清晰的方式使用它,其中有明確理解的參數和參與規則,如果它不起作用,也不會將您置於不安全的境地。 因此,總而言之,可以透過三種方式在您的企業中實施人工智慧。

- 可選:如果需要,可以使用它。 在我們的機構中,每個人都可以根據需要使用它,了解我們作為企業所面臨的風險和最佳實踐。 這是我們的預設位置。

- 必需:在某些情況下可能需要它。 發送大量個人化銷售電子郵件是我們最近在客戶中看到的一個例子。 沒有人工智慧你就無法做到這一點。

- 禁止:出於隱私和保密原因,蘋果已禁止公司內使用人工智慧。 您的業務中也可能存在被禁止的用例。

就道路規則達成一致,探索、調整,不要反應過度,隨著科技的發展而發展。

行銷人員,安全飛行。