解释机器学习中的回归与分类

已发表: 2022-12-19回归和分类是机器学习中最基本和最重要的两个领域。

当您刚刚接触机器学习时,区分回归和分类算法可能很棘手。 了解这些算法的工作原理以及何时使用它们对于做出准确的预测和有效的决策至关重要。

首先,让我们看看机器学习。

什么是机器学习?

机器学习是一种在没有明确编程的情况下教计算机学习和做出决策的方法。 它涉及在数据集上训练计算机模型,允许模型根据数据中的模式和关系做出预测或决策。

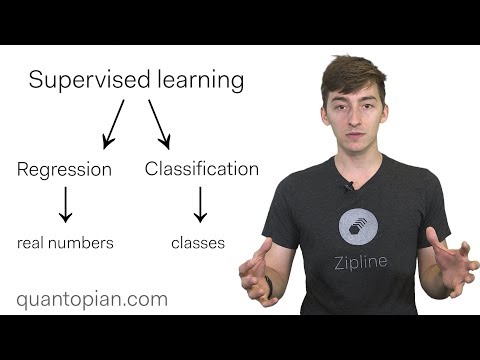

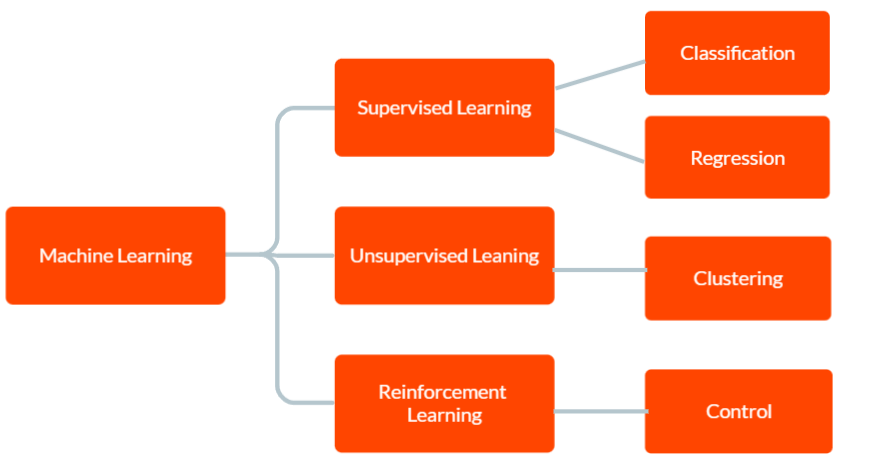

机器学习主要分为三种类型:监督学习、非监督学习和强化学习。

在监督学习中,模型被提供有标记的训练数据,包括输入数据和相应的正确输出。 目标是让模型根据从训练数据中学到的模式预测新的、未见过的数据的输出。

在Unsupervised learning中,模型没有给出任何标记的训练数据。 相反,它需要独立发现数据中的模式和关系。 这可用于识别数据中的组或集群,或查找异常或不寻常的模式。

在强化学习中,代理学习与其环境交互以最大化奖励。 它涉及训练模型根据从环境中收到的反馈做出决策。

机器学习用于各种应用,包括图像和语音识别、自然语言处理、欺诈检测和自动驾驶汽车。 它有可能使许多任务自动化并改善各个行业的决策制定。

本文主要关注监督机器学习下的分类和回归概念。 让我们开始吧!

机器学习中的分类

分类是一种机器学习技术,涉及训练模型为给定输入分配类别标签。 这是一项有监督的学习任务,这意味着模型是在标记的数据集上训练的,该数据集包括输入数据的示例和相应的类标签。

该模型旨在学习输入数据和类标签之间的关系,以预测新的、未见过的输入的类标签。

有许多不同的算法可用于分类,包括逻辑回归、决策树和支持向量机。 算法的选择将取决于数据的特征和模型的期望性能。

一些常见的分类应用包括垃圾邮件检测、情绪分析和欺诈检测。 在每一种情况下,输入数据都可能包括文本、数值或两者的组合。 类别标签可以是二元的(例如,垃圾邮件或非垃圾邮件)或多类别的(例如,正面、中性、负面情绪)。

例如,考虑一个产品的客户评论数据集。 输入数据可能是评论的文本,类别标签可能是评级(例如,正面、中性、负面)。 该模型将在标记评论的数据集上进行训练,然后能够预测它以前从未见过的新评论的评级。

ML 分类算法类型

机器学习中有几种类型的分类算法:

逻辑回归

这是用于二元分类的线性模型。 它用于预测某个事件发生的概率。 逻辑回归的目标是找到最小化预测概率和观察结果之间误差的最佳系数(权重)。

这是通过使用优化算法(例如梯度下降)来调整系数,直到模型尽可能地适合训练数据来完成的。

决策树

这些是基于特征值做出决策的树状模型。 它们可用于二分类和多分类。 决策树有几个优点,包括它们的简单性和互操作性。

它们的训练和预测速度也很快,并且可以处理数字和分类数据。 但是,它们可能容易过度拟合,尤其是当树很深且有很多分支时。

随机森林分类

随机森林分类是一种集成方法,将多个决策树的预测结合起来,做出更准确、更稳定的预测。 它比单个决策树更不容易过度拟合,因为对单个决策树的预测进行了平均,从而减少了模型中的方差。

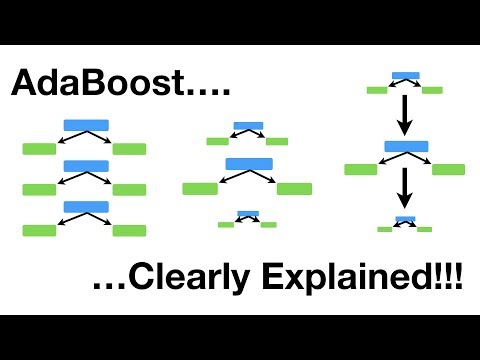

AdaBoost

这是一种提升算法,可以自适应地改变训练集中错误分类示例的权重。 它通常用于二进制分类。

朴素贝叶斯

朴素贝叶斯基于贝叶斯定理,这是一种根据新证据更新事件概率的方法。 它是一种概率分类器,通常用于文本分类和垃圾邮件过滤。

K-最近邻

K 最近邻 (KNN) 用于分类和回归任务。 它是一种非参数方法,根据最近邻居的类别对数据点进行分类。 KNN 有几个优点,包括它的简单性和易于实现的事实。 它还可以处理数值和分类数据,并且不对基础数据分布做出任何假设。

梯度提升

这些是按顺序训练的弱学习器的集合,每个模型都试图纠正前一个模型的错误。 它们可用于分类和回归。

机器学习中的回归

在机器学习中,回归是一种监督学习,其目标是根据一个或多个输入特征(也称为预测变量或自变量)预测 ac 因变量。

回归算法用于对输入和输出之间的关系建模,并根据该关系进行预测。 回归可用于连续和分类因变量。

一般来说,回归的目标是建立一个模型,可以根据输入特征准确预测输出,并理解输入特征和输出之间的潜在关系。

回归分析用于各种领域,包括经济学、金融学、市场营销和心理学,以理解和预测不同变量之间的关系。 它是数据分析和机器学习的基本工具,用于进行预测、识别趋势和了解驱动数据的潜在机制。

例如,在一个简单的线性回归模型中,目标可能是根据房屋的大小、位置和其他特征来预测房屋的价格。 房子的大小和位置是自变量,而房子的价格是因变量。

该模型将根据输入数据进行训练,这些数据包括几所房屋的大小和位置,以及相应的价格。 一旦模型经过训练,就可以根据房屋的大小和位置来预测房屋的价格。

机器学习回归算法类型

回归算法有多种形式,每种算法的使用取决于参数的数量,例如属性值的种类、趋势线的模式和自变量的数量。 经常使用的回归技术包括:

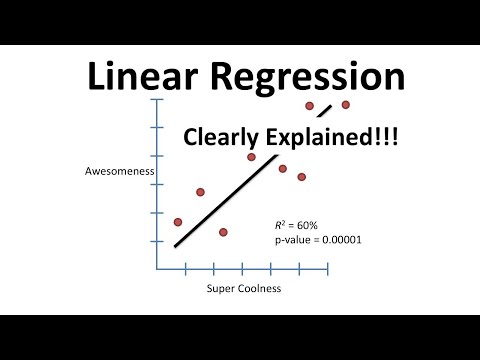

线性回归

这个简单的线性模型用于根据一组特征预测连续值。 它用于通过对数据拟合一条线来对特征与目标变量之间的关系进行建模。

多项式回归

这是一个非线性模型,用于将曲线拟合到数据。 当关系不是线性时,它用于对特征和目标变量之间的关系建模。 它基于向线性模型添加高阶项以捕获因变量和自变量之间的非线性关系的想法。

岭回归

这是一个解决线性回归中过度拟合问题的线性模型。 它是线性回归的正则化版本,向成本函数添加惩罚项以降低模型的复杂性。

支持向量回归

与 SVM 一样,支持向量回归是一种线性模型,它试图通过找到最大化因变量和自变量之间的差值的超平面来拟合数据。

然而,与用于分类的 SVM 不同,SVR 用于回归任务,其目标是预测连续值而不是类别标签。

套索回归

这是另一个正则化线性模型,用于防止线性回归中的过度拟合。 它根据系数的绝对值向成本函数添加惩罚项。

贝叶斯线性回归

贝叶斯线性回归是一种基于贝叶斯定理的线性回归的概率方法,它是一种根据新证据更新事件概率的方法。

该回归模型旨在估计给定数据的模型参数的后验分布。 这是通过定义参数的先验分布,然后使用贝叶斯定理根据观察到的数据更新分布来完成的。

回归与分类

回归和分类是监督学习的两种类型,这意味着它们用于根据一组输入特征来预测输出。 但是,两者之间存在一些关键差异:

| 回归 | 分类 | |

| 定义 | 一种预测连续值的监督学习 | 一种预测分类值的监督学习 |

| 输出类型 | 连续的 | 离散的 |

| 评价指标 | 均方误差(MSE)、均方根误差(RMSE) | 准确率、精确率、召回率、F1 分数 |

| 算法 | 线性回归、Lasso、Ridge、KNN、决策树 | 逻辑回归、SVM、朴素贝叶斯、KNN、决策树 |

| 模型复杂度 | 不太复杂的模型 | 更复杂的模型 |

| 假设 | 特征和目标之间的线性关系 | 没有关于特征和目标之间关系的特定假设 |

| 阶级失衡 | 不适用 | 这可能是个问题 |

| 异常值 | 会影响模型的性能 | 通常不是问题 |

| 特征重要性 | 功能按重要性排序 | 功能不按重要性排序 |

| 示例应用程序 | 预测价格、温度、数量 | 预测是否是垃圾邮件,预测客户流失 |

学习资源

选择最好的在线资源来理解机器学习概念可能具有挑战性。 我们检查了可靠平台提供的热门课程,向您推荐了有关回归和分类的顶级 ML 课程。

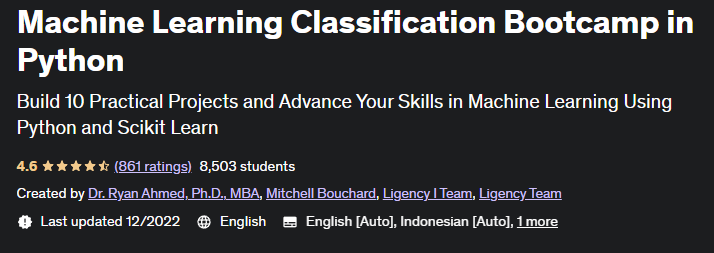

#1。 Python 机器学习分类训练营

这是 Udemy 平台上提供的课程。 它涵盖了多种分类算法和技术,包括决策树和逻辑回归,并支持向量机。

您还可以了解诸如过度拟合、偏差-方差权衡和模型评估等主题。 本课程使用 sci-kit-learn 和 pandas 等 Python 库来实现和评估机器学习模型。 因此,开始本课程需要基本的 Python 知识。

#2。 Python 机器学习回归大师班

在此 Udemy 课程中,培训师涵盖了各种回归算法的基础知识和基础理论,包括线性回归、多项式回归以及套索和岭回归技术。

在本课程结束时,您将能够实施回归算法并使用各种关键性能指标评估经过训练的机器学习模型的性能。

包起来

机器学习算法在许多应用程序中都非常有用,它们可以帮助自动化和简化许多流程。 机器学习算法使用统计技术来学习数据中的模式,并根据这些模式做出预测或决策。

它们可以接受大量数据的训练,并可用于执行人类手动完成的困难或耗时的任务。

每种 ML 算法都有其优点和缺点,算法的选择取决于数据的性质和任务的要求。 为您要解决的特定问题选择合适的算法或算法组合很重要。

为您的问题选择正确类型的算法很重要,因为使用错误类型的算法会导致性能不佳和预测不准确。 如果您不确定要使用哪种算法,尝试回归和分类算法并比较它们在您的数据集上的性能会很有帮助。

我希望你发现这篇文章有助于学习机器学习中的回归与分类。 您可能也有兴趣了解顶级机器学习模型。