Навигация по этике ИИ в рекрутинге

Опубликовано: 2023-07-21В последние годы мир найма претерпел значительные изменения благодаря быстрому развитию технологий искусственного интеллекта (ИИ).

ИИ произвел революцию во многих аспектах процесса найма, предложив инновационные инструменты и решения, которые автоматизируют рабочие процессы, улучшают процесс принятия решений и повышают качество работы кандидатов.

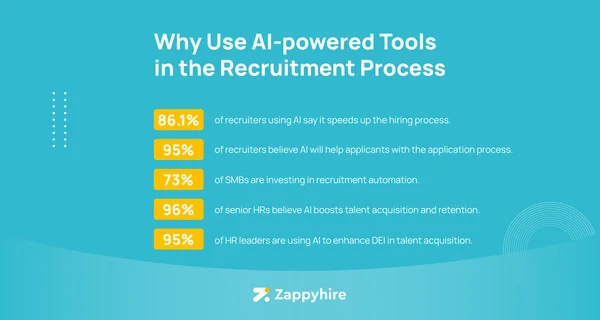

Влияние ИИ на набор персонала имеет впечатляющую статистику.

Ошеломляющие 96% старших специалистов по персоналу считают, что ИИ значительно улучшит привлечение и удержание талантов. Кроме того, 86,1% рекрутеров, использующих ИИ, подтверждают, что он ускоряет процесс найма, что демонстрирует его эффективность и возможности экономии времени.

Внедрение ИИ в рекрутменте широко распространено: по крайней мере 73% компаний инвестируют в автоматизацию рекрутинга, чтобы оптимизировать свои усилия по поиску талантов. Эта тенденция подкрепляется тем, что 85% рекрутеров считают ИИ полезным в своей практике найма.

Однако по мере того, как мы используем эту трансформирующую технологию, мы также должны учитывать этику ИИ при найме. Хотя ИИ предлагает множество преимуществ, он также создает проблемы и потенциальные ловушки, которые необходимо тщательно обходить.

В этом блоге мы рассмотрим тонкости ИИ при найме, рассмотрим его потенциал и подчеркнем важность этических соображений при его внедрении.

Источник: Zappyhire

Прежде чем углубляться в этические последствия, давайте сначала установим четкое определение и область применения ИИ при найме.

Что такое ИИ в рекрутменте?

ИИ при наборе персонала относится к использованию алгоритмов машинного обучения (ML), обработки естественного языка (NLP) и других методов ИИ для автоматизации или расширения различных этапов процесса найма. Это также называется программным обеспечением для автоматизации подбора персонала.

Какова сфера применения ИИ в рекрутменте?

В контексте трудоустройства это может быть что угодно: от алгоритма, который рекомендует кандидатов на основе ваших конкретных требований (например, «Мне нужен человек, работавший в таких компаниях, как Google или Amazon»), вплоть до программного обеспечения для проведения видеоинтервью или чат-ботов, которые отбирают кандидатов для вас, задавая им вопросы об их прошлом опыте и наборе навыков.

Программное обеспечение для рекрутинга на базе искусственного интеллекта становится все более распространенным в отделах кадров, обычно называемое «HR-технологией» или «технологией талантов». Давайте посмотрим на некоторые из них.

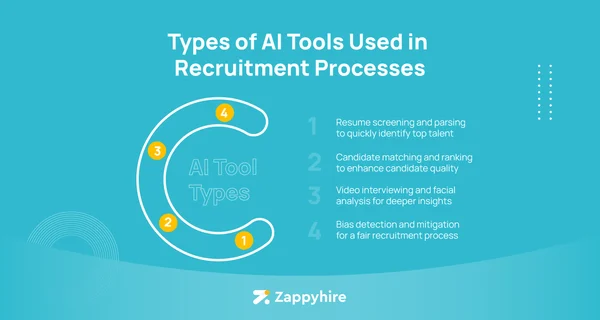

Типы инструментов ИИ, используемых в процессах найма

От проверки резюме и сопоставления кандидатов до видеоинтервью и обнаружения предвзятости, инструменты ИИ способны автоматизировать трудоемкие задачи найма и оптимизировать общий опыт найма для всех, включая кандидатов.

1. Возобновление проверки и разбора

Один из начальных этапов подбора персонала включает в себя рассмотрение огромного количества резюме. Инструменты проверки и анализа резюме на основе ИИ могут быстро анализировать резюме, извлекать необходимую информацию и определять лучших кандидатов на основе заранее заданных вами критериев.

Это снижает вашу нагрузку, позволяя вам сосредоточиться на более стратегических аспектах привлечения талантов.

2. Сопоставление кандидатов и ранжирование

Инструменты сопоставления и ранжирования кандидатов на основе ИИ используют алгоритмы, которые учитывают различные факторы, такие как навыки, опыт и культурное соответствие, чтобы определить наиболее подходящих кандидатов для каждой роли.

Это экономит время и повышает качество кандидатов, с которыми вы встретитесь.

3. Видеоинтервью и анализ лица

Видеоинтервью приобрели популярность в последние годы, предлагая удобство кандидатам и рекрутерам.

Инструменты видеоинтервью на базе искусственного интеллекта выходят за рамки простой видеоконференции, анализируя выражение лица, тон голоса и язык тела, чтобы получить более глубокое представление о том, подходит ли кандидат для той или иной роли.

Однако важно сбалансировать преимущества такого анализа с проблемами конфиденциальности и потенциальной предвзятостью.

4. Обнаружение и устранение предвзятости

ИИ умеет устранять предвзятость при найме, удаляя человеческую субъективность из процесса принятия решений. Алгоритмы машинного обучения могут обнаруживать и устранять предвзятость в описаниях должностей, оценке кандидатов и процессах отбора.

Однако, несмотря на то, что ИИ определенно находится на пути к снижению предвзятости при наборе персонала, люди по-прежнему влияют на него. Полное устранение предвзятости — далекая цель. Этическое использование ИИ при найме означает продвижение справедливости и инклюзивности, а также стремление к разнообразию рабочей силы — работа над ИИ продолжается.

Источник: Zappyhire

Понимание предвзятости в системах найма ИИ

Алгоритмическая предвзятость является серьезной проблемой в системах найма ИИ, поскольку она может увековечить неравенство и привести к дискриминационным результатам. Изучите источники и проявления предвзятости, чтобы эффективно решать свои проблемы.

Давайте поговорим о двух ключевых аспектах предвзятости в системах найма ИИ: предвзятости обучающих данных и различных проявлениях предвзятости.

Предвзятые данные обучения и увековечивание неравенства

Одним из основных источников предвзятости в системах найма ИИ являются предвзятые данные обучения.

Алгоритмы ИИ учатся на исторических данных, которые отражают существующие в обществе предрассудки и неравенство. Если данные обучения преимущественно представляют определенную демографическую группу или демонстрируют несправедливые закономерности, система ИИ может увековечить эти предубеждения в своих процессах принятия решений.

Например, если набор данных, используемый для обучения системы ИИ, содержит в основном резюме из определенной демографической группы, алгоритм может непреднамеренно отдать предпочтение кандидатам из этой демографической группы, что приведет к исключению других квалифицированных лиц. Убедитесь, что вы работаете с разнообразными и репрезентативными тренировочными данными, чтобы избежать предвзятости.

Проявления предвзятости в системах ИИ

Вы должны знать о различных проявлениях предвзятости в системах найма, чтобы эффективно справляться с ними. Давайте рассмотрим два распространенных проявления: образовательные и географические предубеждения и предубеждения по языку и ключевым словам.

1. Образовательные и географические предубеждения: непреднамеренные исключения

Системы ИИ, обученные на необъективных данных, могут демонстрировать образовательные и географические предубеждения. Как и в приведенном выше примере, если обучающие данные преимущественно состоят из кандидатов из престижных университетов или определенных географических регионов, система ИИ может непреднамеренно отдавать предпочтение кандидатам с аналогичным образованием или из определенных областей. Это может привести к исключению других квалифицированных кандидатов из альтернативных образовательных путей или других мест.

Непреднамеренные исключения, основанные на образовательных и географических предубеждениях, препятствуют разнообразию и ограничивают ваш потенциальный кадровый резерв. Убедитесь, что ваши системы искусственного интеллекта учитывают широкий спектр образования и географического положения, чтобы предотвратить дискриминацию.

2. Языковые и ключевые предубеждения: бессознательная дискриминация

Предвзятость по языку и ключевым словам — еще два проявления предвзятости в системах найма ИИ. Алгоритмы ИИ могут научиться ассоциировать определенные слова или фразы с желательными или нежелательными атрибутами-кандидатами, что может привести к бессознательной дискриминации.

Например, если определенные ключевые слова или фразы связаны с полом, возрастом или расой в обучающих данных, система ИИ может непреднамеренно отдавать предпочтение или наказывать кандидатов на основе этих факторов.

Устранение предвзятости языка и ключевых слов требует тщательного изучения обучающих данных и алгоритмического дизайна. Сделайте все возможное, чтобы гарантировать, что ваша система искусственного интеллекта не будет проводить дискриминацию на основе защищенных характеристик, а оценки на основе языка будут объективными.

Чтобы уменьшить предвзятость в системах найма ИИ, применяйте лучшие практики, такие как разнообразные и репрезентативные данные об обучении, регулярные проверки предвзятости и оценки систем ИИ, а также повышайте прозрачность и объяснимость.

Организации способствуют справедливости, инклюзивности и равным возможностям в процессе найма, активно выявляя и устраняя предубеждения.

Подробнее: Как ориентироваться в этике генеративного ИИ в мире HR →

Этика ИИ при найме

Использование ИИ для найма по своей сути не является неэтичным, но может привести к непреднамеренной предвзятости. Некоторые исследования показывают, что инструменты рекрутинга на основе ИИ более эффективны, чем традиционные, и хотя на первый взгляд они могут быть более эффективными, чем рекрутеры-люди, у них также есть недостатки.

Серьезное беспокойство вызывает то, что, поскольку инструменты ИИ полагаются на наборы данных, отражающие существующие в обществе предубеждения, они также будут увековечивать эти предубеждения в процессе принятия решений.

Негативное влияние на разнообразие и инклюзивность

Смещение может возникать из-за искаженных обучающих данных, алгоритмов или интерпретаций выходных данных.

Допустим, инструмент для подбора персонала на базе искусственного интеллекта обучается на исторических данных технологической компании. Компания имеет долгую историю найма кандидатов из авторитетных университетов. Эта тенденция заложена в исторических данных.

Эта предвзятость может непреднамеренно поддерживаться, когда инструмент ИИ оценивает кандидатов. После обучения алгоритм отдает приоритет кандидатам из предопределенных университетов в своей базе данных и пропускает других квалифицированных кандидатов с соответствующими навыками и опытом.

Смещение возникает из-за искаженных данных обучения и проявляется в форме фаворитизма. Алгоритм искусственного интеллекта, предназначенный для улучшения процесса найма, непреднамеренно увековечивает существующие предубеждения, разглашая результаты справедливой и всеобъемлющей оценки кандидатов.

Проблемы прозрачности и объяснимости

Системы искусственного интеллекта сложны и трудны для интерпретации, поэтому кандидатам и рекрутерам сложно понять, почему принимаются те или иные решения. Отсутствие прозрачности подрывает доверие к процессу найма и вызывает опасения по поводу справедливости и подотчетности.

Ясность в алгоритмическом принятии решений

Чтобы решить проблемы с прозрачностью, предоставьте четкие пояснения о том, как работают алгоритмы ИИ, о факторах, влияющих на принятие решений, и о критериях, которые он использует для оценки кандидатов. Открытое общение и прозрачность позволяют кандидатам понимать и доверять процессу найма на основе ИИ. На самом деле, 48% соискателей говорят, что отсутствие надлежащей обратной связи является одним из самых неприятных моментов при приеме на работу.

Вопросы конфиденциальности и защиты данных

Вы должны собирать и хранить конфиденциальные данные о кандидатах, когда используете ИИ для найма талантов. Это вызывает опасения по поводу конфиденциальности и защиты данных. Вы должны убедиться, что у вас есть информированное согласие каждого кандидата и что их информация надежно хранится и защищена от несанкционированного доступа или неправомерного использования. Соблюдение соответствующих правил защиты данных, таких как GDPR, жизненно важно для защиты конфиденциальности кандидата.

Безопасность данных и неправомерное использование

Примите надежные меры безопасности данных для защиты информации о кандидатах. Это включает в себя внедрение протоколов шифрования, контроль доступа и регулярные проверки безопасности. Кроме того, вы должны установить четкие правила хранения данных и гарантировать, что данные кандидатов используются только в целях найма и не передаются третьим лицам без согласия.

Каковы лучшие практики этичного использования ИИ при найме?

При правильном использовании программное обеспечение для подбора персонала приносит массу преимуществ вашему процессу. На самом деле, интеграция ИИ в процесс найма оказалась наиболее полезной при поиске кандидатов: 58% рекрутеров считают ИИ ценным в этом отношении, за ними следуют отбор кандидатов (56%) и взращивание кандидатов (55%).

Положительное восприятие ИИ распространяется не только на рекрутеров, поскольку 80% руководителей считают, что ИИ может повысить производительность и производительность в их организациях.

Даже на начальном этапе внедрения программное обеспечение для рекрутинга на основе ИИ продемонстрировало замечательные результаты. Ранние пользователи испытали значительное снижение стоимости экрана, с ошеломляющим снижением на 75%.

Оборот также заметно снизился на 35%. Эти результаты, сделанные еще в 2017 году, четко свидетельствуют о положительном эффекте внедрения ИИ в процессе найма.

Теперь давайте рассмотрим некоторые передовые методы обеспечения справедливости, точности и прозрачности вашего процесса найма.

Обеспечьте разнообразие обучающих данных

Алгоритмы ИИ учатся на данных, на которых они обучаются. Чтобы предотвратить сохранение предубеждений, убедитесь, что ваши обучающие данные репрезентативны для пула кандидатов. Активно боритесь с недостаточной представленностью и собирайте данные из разных источников, чтобы создать более инклюзивную и справедливую систему найма ИИ.

Проводить регулярные аудиты систем ИИ для выявления предвзятости

Чтобы поддерживать целостность систем найма ИИ, настройте регулярные проверки и оценки для выявления любых потенциальных предубеждений. Эти оценки помогают выявлять и устранять системные предубеждения, чтобы повысить общую справедливость процесса найма. Постоянно отслеживая и оценивая системы искусственного интеллекта, вы подтверждаете, что они соответствуют этическим стандартам и обеспечивают беспристрастные результаты.

Повышение прозрачности и объяснимости

Используйте интерпретируемые модели и алгоритмы ИИ, которые дают четкое объяснение принимаемых ими решений. Сообщая о роли ИИ в процессе найма и факторах, учитываемых при принятии решений, вы помогаете кандидатам и рекрутерам понять эту технологию и доверять ей.

Когда кандидаты получают уведомления или отзывы на основе оценок ИИ, причины этих решений должны быть объяснены таким образом, чтобы они были понятны и значимы для них. Эта прозрачность помогает кандидатам ориентироваться в процессе найма и укрепляет доверие к системе ИИ.

Обеспечьте конфиденциальность и защиту данных

Поскольку ИИ опирается на данные кандидатов, вы должны отдавать приоритет конфиденциальности и защите данных. Обеспечьте соблюдение соответствующих правил защиты данных, таких как GDPR или Калифорнийский закон о конфиденциальности потребителей (CCPA).

Внедрите надежные меры безопасности для защиты информации о кандидатах от несанкционированного доступа, использования или взлома. Защищая конфиденциальность, вы можете установить доверие и уверенность в использовании ИИ при наборе персонала.

Гарантия подотчетности и ответственности

Чтобы способствовать ответственному внедрению ИИ при наборе персонала, установите четкие правила использования ИИ и принятия решений. Назначьте подотчетных лиц или группы, ответственные за эффективность системы найма ИИ и соблюдение этических норм.

Регулярный мониторинг и управление системами ИИ помогут обеспечить подотчетность, снизить потенциальные риски и способствовать этичному поведению на протяжении всего процесса найма.

Баланс между эффективностью ИИ и человеческим суждением

Хотя ИИ может повысить эффективность процессов найма, вам необходимо найти баланс между эффективностью ИИ и человеческим суждением. ИИ следует рассматривать как инструмент для поддержки и улучшения нашего процесса принятия решений, а не как его замену. Обеспечьте контроль и проверку со стороны человека, чтобы убедиться, что выбор на основе ИИ соответствует ценностям и этике организации.

Человеческое суждение привносит в процесс найма важные качества, такие как эмпатия, интуиция и понимание контекста. На самом деле, немного человеческого ноу-хау в сочетании с системой искусственного интеллекта — это все, что нужно, чтобы обеспечить быстрый процесс найма на основе данных.

Значительные 68% рекрутеров считают, что использование ИИ в процессе найма может эффективно устранить непреднамеренную предвзятость и способствовать объективной оценке кандидатов.

Источник: Zappyhire

Дополните процесс принятия решений человеком с помощью ИИ, чтобы расширить возможности рекрутеров

ИИ обеспечивает автоматизацию и аналитику на основе данных, но вы должны признать ценность принятия решений человеком и эффективно использовать его.

«Использование возможностей взаимодействия человека и искусственного интеллекта в процессе найма является ключом к открытию новой эры привлечения талантов».

Джотис К.С.

Соучредитель, Zappyhire

Убежденный пропагандист принятия решений «сначала человек», Джиотис восстанавливает: «Вместе мы можем объединить идеи и возможности искусственного интеллекта с человеческим прикосновением, чтобы раскрыть скрытый потенциал, принимать беспристрастные решения и создавать разнообразные и исключительные команды».

Давайте рассмотрим некоторые важные аспекты, о которых следует помнить.

Включение человеческого надзора и проверки в процессы найма ИИ

Способность ИИ автоматизировать повторяющиеся задачи, анализировать огромные объемы данных, выявлять закономерности и предоставлять информацию на основе данных позволяет вам делать более осознанный выбор, экономя драгоценное время.

Однако ИИ не заменяет человеческого суждения. Вы должны включить человеческий надзор и проверку, чтобы обеспечить справедливость, смягчить предубеждения и интерпретировать сложные контексты, которые алгоритмы ИИ могут не полностью понять. Человеческое прикосновение позволяет глубже понять кандидатов, потому что мы учитываем субъективные факторы и обеспечиваем необходимое сочувствие, которого может не хватать ИИ.

Вот как вы можете найти правильный баланс между технологией искусственного интеллекта и человеческим суждением.

1. Наладьте совместный рабочий процесс

Внедрите совместный рабочий процесс, в котором технология искусственного интеллекта и человеческий опыт идут рука об руку. Поручите своим рекрутерам анализировать рекомендации и решения ИИ, чтобы подтвердить их соответствие ценностям организации, этическим стандартам и требованиям законодательства.

2. Поощряйте постоянное обучение и совершенствование

Стимулируйте культуру непрерывного обучения и совершенствования, регулярно оценивая производительность систем ИИ. Это позволяет выявлять и устранять любые потенциальные предубеждения, а также повышать точность и объективность предложений, генерируемых ИИ.

3. Установите четкие правила использования ИИ

Определите четкие правила и политики использования ИИ в процессах найма. Укажите роли и обязанности специалистов по технологии ИИ, рекрутеров и заинтересованных сторон. Эта ясность гарантирует, что ИИ используется этично и в соответствии с целями организации.

4. Назначьте ответственных лиц или группы

Чтобы контролировать системы найма ИИ и соблюдать этические нормы, эти члены команды должны иметь глубокое понимание технологии ИИ, ее ограничений и потенциальных рисков.

ИИ и человеческое суждение: синергетические отношения

По мере того, как ландшафт найма меняется, вы должны узнать, как ваша компания будет осторожно и проницательно ориентироваться на пересечении ИИ и человеческого суждения. Используя лучшее из обоих миров, вы можете улучшить свои методы найма и положительно повлиять на кандидатов, с которыми вы взаимодействуете, что также повышает ваш бренд работодателя.

В конечном счете, успешная интеграция ИИ и человеческого суждения закладывает основу для более эффективного, инклюзивного и действенного процесса найма.

Умный найм вызывает использование умных технологий. Узнайте, как рекрутинговые чат-боты упрощают общение с потенциальными кандидатами и повышают вашу планку на конкурентном рынке труда.