Улучшит ли самоклассификация постов в социальных сетях ключевые проблемы модерации онлайн-речи?

Опубликовано: 2022-12-16Модерация контента в настоящее время является горячей темой в кругах социальных сетей, поскольку Илон Маск занимается реформированием Twitter, одновременно публикуя прошлые действия по модерации, как иллюстрацию того, как приложения социальных сетей получили слишком много власти, чтобы контролировать определенные обсуждения.

Но, несмотря на то, что Маск подчеркивал предполагаемые недостатки в процессе, теперь возникает вопрос, как их исправить? Если решения о контенте нельзя доверять в руках, по сути, небольших групп руководителей, отвечающих за сами платформы, то какая альтернатива?

Эксперимент Meta с группой внешних экспертов в целом увенчался успехом, но даже в этом случае Наблюдательный совет не может выносить решения по каждому решению в отношении контента, и Meta по-прежнему подвергается резкой критике за предполагаемую цензуру и предвзятость, несмотря на эти альтернативные средства. апелляции.

На каком-то уровне какой-то элемент принятия решений неизбежно ляжет на управление платформой, если только нельзя будет придумать другой путь.

Могут ли альтернативные каналы, основанные на личных предпочтениях, быть еще одним способом решения этой проблемы?

Некоторые платформы изучают это. Как сообщает The Washington Post, TikTok в настоящее время изучает концепцию, которую он называет «Уровни контента», чтобы не допустить появления «зрелого» контента в лентах молодых зрителей.

TikTok стал объектом все более пристального внимания на этом фронте, особенно в отношении тенденций опасных испытаний, в результате которых некоторые молодые люди были убиты в результате участия в рискованных действиях.

Илон Маск также рекламировал аналогичный подход к управлению контентом как часть своего более широкого видения «Twitter 2.0».

Хорошая точка зрения.

— Илон Маск (@elonmusk) 29 октября 2022 г.

Вероятно, лучше иметь возможность выбирать, какую версию Twitter вы хотите, так же, как это было бы для рейтинга зрелости фильмов.

Рейтинг самого твита можно было выбрать самостоятельно, а затем изменить по отзывам пользователей.

В варианте Маска пользователи будут самостоятельно классифицировать свои твиты по мере их загрузки, а читатели также смогут применять свой собственный рейтинг зрелости, чтобы помочь перенести потенциально опасный контент в отдельную категорию.

Конечный результат в обоих случаях будет означать, что пользователи затем смогут выбирать из разных уровней взаимодействия с приложением — от «безопасного», который будет отфильтровывать наиболее экстремальные комментарии и обсуждения, до «нефильтрованного» (Маск, вероятно, пойдет дальше). с «хардкором»), что даст вам полный опыт.

Звучит интересно в теории, но на самом деле будут ли пользователи самостоятельно классифицировать свои твиты, и будут ли они правильно оценивать эти рейтинги достаточно часто, чтобы сделать это приемлемым вариантом для такого типа фильтрации?

Конечно, платформа может ввести наказания за неклассификацию или неправильную классификацию ваших твитов. Возможно, для повторных правонарушителей все их твиты автоматически фильтруются в более экстремальную сегментацию, в то время как другие могут получить максимальный охват аудитории, отображая свой контент в обоих или во всех потоках.

Это потребует от пользователей больше ручной работы при выборе классификации в процессе составления, но, может быть, это могло бы облегчить некоторые проблемы?

Но опять же, это все равно не остановит использование социальных платформ для разжигания ненависти и разжигания опасных движений.

В большинстве случаев, когда Twitter или другие социальные приложения подвергались цензуре пользователей, это происходило из-за угрозы причинения вреда, а не потому, что люди обязательно оскорбляются оставленными комментариями.

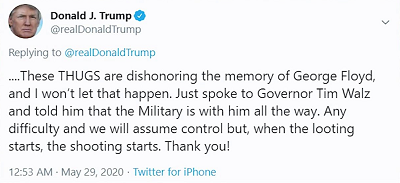

Например, когда бывший президент Дональд Трамп написал:

Обеспокоенность заключалась не столько в том, что люди будут оскорблены его комментарием «когда начнутся грабежи, начнется стрельба», а в том, что сторонники Трампа могут воспринять это, по сути, как лицензию на убийство, а президент фактически одобрил применение смертоносной силы для сдерживания мародеров.

Социальные платформы, по логике вещей, не хотят, чтобы их инструменты использовались для распространения потенциального вреда таким образом, и в этом отношении самоцензура или выбор рейтинга зрелости для ваших сообщений не решит эту ключевую проблему, она просто скройте такие комментарии от пользователей, которые предпочитают их не видеть.

Другими словами, это скорее запутывание, чем повышение безопасности, но многие, кажется, считают, что основная проблема не в том, что люди говорят и хотят говорить такие вещи в Интернете, а в том, что другие обижаются на такие вещи.

Это не проблема, и хотя сокрытие потенциально оскорбительного материала может иметь некоторую ценность для уменьшения воздействия, особенно в случае с TikTok, для более молодой аудитории, это все же не помешает людям использовать огромный потенциал социальных приложений для распространения ненависти. и опасные призывы к действию, которые действительно могут нанести реальный вред.

По сути, это разрозненное предложение, разбавление ответственности, которое в некоторых случаях будет иметь некоторое влияние, но не будет касаться основной ответственности социальных платформ, чтобы гарантировать, что инструменты и системы, которые они создали, не используются для опасных целей. цель.

Потому что они есть и останутся. Социальные платформы использовались для разжигания гражданских беспорядков, политических восстаний, беспорядков, военных переворотов и многого другого.

Буквально на этой неделе против Meta был подан новый судебный иск за то, что он позволил « распространить на Facebook жестокие и ненавистные посты в Эфиопии, разжигая кровавую гражданскую войну в стране ». В иске содержится иск о возмещении ущерба жертвам насилия в размере 2 миллиардов долларов.

Речь идет не только о политических взглядах, с которыми вы не согласны, платформы социальных сетей могут использоваться для разжигания реальных, опасных движений.

В таких случаях никакая самосертификация вряд ли поможет — платформы всегда будут нести некоторую ответственность за установление правил, чтобы гарантировать, что эти типы наихудших сценариев рассматриваются.

Это или правила должны быть установлены на более высоком уровне правительствами и агентствами, призванными измерять их влияние и действовать соответственно.

Но, в конце концов, основная проблема здесь не в социальных платформах, позволяющих людям говорить то, что они хотят, и делиться тем, что им нравится, как настаивают многие сторонники «свободы слова». На каком-то уровне всегда будут ограничения, всегда будут ограждения, и временами они могут выходить за рамки законов страны, учитывая потенциал усиления социальных постов.

Простых ответов не существует, но, если оставить это на усмотрение народа, ситуация вряд ли улучшится на всех фронтах.