Jaka przyszłość czeka genAI? Cykl szumu Gartnera

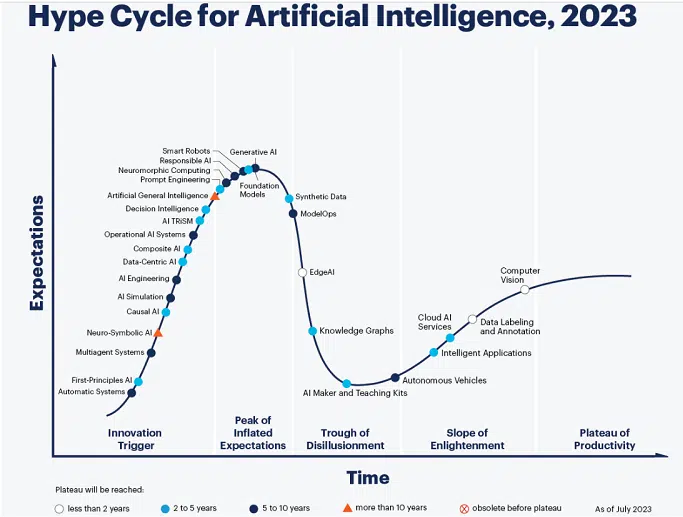

Opublikowany: 2023-09-21Nie jest dla nikogo zaskoczeniem, że generatywna sztuczna inteligencja i podstawowe modele ją wspierające znajdują się obecnie na samym szczycie tego, co Gartner nazywa „szczytem zawyżonych oczekiwań” w najnowszej iteracji „cyklu szumu Gartnera dotyczącego sztucznej inteligencji”. Oznacza to, że balansują na krawędzi przepaści, która może wrzucić ich do „rynny rozczarowania”.

Rozmawialiśmy z Afrazem Jaffrim, dyrektorem analitykiem w firmie Gartner, specjalizującym się w analityce, analizie danych i sztucznej inteligencji, o tym, jak powinniśmy interpretować sytuację. Wywiad został zredagowany pod kątem długości i przejrzystości.

P: Przewidujesz, że podstawowe modele zajmą od dwóch do pięciu lat, a osiągnięcie „plateau produktywności” przez generatywną sztuczną inteligencję zajmie od pięciu do dziesięciu lat. Na czym to polega?

Odpowiedź: To tutaj możemy zaobserwować prawdziwe przyjęcie, nie tylko wśród wybranej liczby przedsiębiorstw, co prawdopodobnie nastąpi znacznie szybciej, ale na wszystkich poziomach organizacji – głównie w formie pakietów aplikacji. Każde oprogramowanie będzie zawierało jakąś funkcję generatywnej sztucznej inteligencji, ale zrozumienie rzeczywistego wzrostu produktywności wynikającego z tych funkcji zajmie więcej czasu. To wyścig, w którym każdy może dostarczyć generatywną sztuczną inteligencję lub funkcję w swoim oprogramowaniu; we wszystkich tych przypadkach osiągnięcie korzyści i ich zmierzenie zajmie więcej czasu.

Modele podstawowe obejmują szerokie spektrum; nie tylko duże modele językowe, ale także modele obrazów i wideo. Dlatego czas na plateau będzie dłuższy. To wiadro wszelkiego rodzaju modeli.

Kop głębiej: dlaczego zależy nam na sztucznej inteligencji w marketingu

P: Można sobie wyobrazić rzeczy, które mogłyby bardzo zakłócić generatywną sztuczną inteligencję. Jednym z nich są regulacje – zwłaszcza w Europie istnieją poważne obawy dotyczące dużych modeli językowych służących do usuwania danych osobowych. Drugie dotyczy praw autorskich. Czy uwzględniłeś tego rodzaju możliwe zakłócenia?

O: Tak, są częścią myślenia. Pierwszą kwestią jest właściwie aspekt zaufania. Niezależnie od zewnętrznych przepisów, nadal panuje powszechne przekonanie, że bardzo trudno jest kontrolować dane wyjściowe modeli i zagwarantować, że dane wyjściowe są rzeczywiście prawidłowe. To duża przeszkoda. Jak wspomniałeś, istnieje również chmura wokół przepisów. Jeśli w Europie modele zostaną objęte istotnymi regulacjami, mogą nawet nie być dostępne; już od jakiegoś czasu widzieliśmy tam usunięty ChatGPT. Jeśli duże przedsiębiorstwa uznają, że spełnienie wymagań jest zbyt trudne, mogą po prostu wycofać swoje usługi z tego regionu.

Jest jeszcze strona prawna. Modele te opierają się, jak powiedziałeś, na danych zawierających dane chronione prawem autorskim pobrane z Internetu. Jeśli dostawcy tych danych zaczną prosić o odpowiedni wykup, będzie to miało wpływ również na przyszły poziom wykorzystania tych modeli. Następnie jest strona bezpieczeństwa. Jak zabezpieczyć te modele przed atakami. Zdecydowanie trochę przeciwnego wiatru, żeby nawigować.

P: Wiele słyszymy o „człowieku w pętli”. Zanim udostępnisz odbiorcom cokolwiek stworzonego przez generatywną sztuczną inteligencję, musisz uzyskać weryfikację i zatwierdzenie przez człowieka. Ale jedną z zalet genAI jest szybkość i skala jego kreatywności. Jak ludzie mogą dotrzymać kroku?

O: Prędkość i skala są po to, aby ludzie mogli robić to, co muszą. Ma pomóc ludziom, którzy, powiedzmy, muszą przejrzeć 10 dokumentów, aby uzyskać odpowiedź na coś; teraz mogą to zrobić w ciągu jednej minuty. Ze względu na kwestię zaufania są to najcenniejsze typy zadań, do których można używać modelu językowego.

P: Jeśli odpowiedzialna sztuczna inteligencja będzie za pięć do dziesięciu lat od plateau, wygląda na to, że przewidujesz wyboistą drogę.

O: Świat regulacyjny i inne systemy są nieznane; a nawet gdy zostaną sformalizowane i znane, w różnych regionach geograficznych będą obowiązywać różne regulacje. Wrodzoną naturą tych modeli jest to, że mają tendencję do tego, aby nie były bezpieczne. Nauka kontrolowania tego zajmie trochę czasu. Jak sprawdzić, czy model będzie bezpieczny? Jak audytować model pod kątem zgodności? Dla ochrony? Najlepsze praktyki są trudne do znalezienia; każda organizacja stosuje własne podejście. Zapomnij o generatywnej sztucznej inteligencji, inne modele sztucznej inteligencji, te, które są stosowane przez organizacje od jakiegoś czasu, nadal popełniają błędy, nadal wykazują uprzedzenia.

P: Jak ludzie powinni przygotować się na nieuchronną dolinę rozczarowania?

Odp.: Organizacje będą podążać różnymi ścieżkami w swoich doświadczeniach z generatywną sztuczną inteligencją, więc nie musi to koniecznie oznaczać, że organizacja musi wpaść w dołek. Zwykle dzieje się tak, gdy oczekiwania nie są zarządzane. Jeśli zaczniesz od przyjrzenia się konkretnym przypadkom użycia, konkretnym elementom implementacji i będziesz mieć dobre wskaźniki sukcesu, a także inwestycje w zarządzanie i organizację danych; dobre rządzenie, dobra polityka; jeśli połączysz to wszystko z praktyczną narracją o tym, co potrafią modele, zapanujesz nad szumem i jest mniej prawdopodobne, że wpadniesz w dołek.

P: Czy powiedziałbyś, że cykl szumu dotyczącego sztucznej inteligencji przebiega szybciej niż inne, które widziałeś?

Odpowiedź: Cykl szumu dotyczącego sztucznej inteligencji ma tendencję do skupiania się na innowacjach, które rzeczywiście poruszają się szybciej po krzywej – i zwykle mają większy wpływ na to, co mogą zrobić. W tej chwili jest to główny ośrodek inicjatyw związanych z finansowaniem dla VC. Jest to bardzo ważny obszar, także w przestrzeni badawczej. Wiele z tych rzeczy pochodzi ze środowiska akademickiego, które jest bardzo aktywne w tej przestrzeni.

P: Wreszcie AGI, czyli sztuczna inteligencja ogólna (AI, która replikuje ludzką inteligencję). Masz to za dziesięć lat lub więcej. Czy zabezpieczasz swoje zakłady, bo może to w ogóle nie być możliwe?

O: Tak. Mamy znacznik, który jest „przestarzały przed plateau”. Istnieje argument, że tak naprawdę nigdy nie nastąpi, ale my twierdzimy, że zajmie to więcej niż 10 lat, ponieważ istnieje wiele różnych interpretacji tego, czym w rzeczywistości jest AGI. Wielu szanowanych badaczy twierdzi, że jesteśmy na ścieżce, która doprowadzi nas do AGI, ale potrzeba znacznie więcej przełomów i innowacji, aby zobaczyć, jak ta ścieżka faktycznie wygląda. Uważamy, że jest to coś bardziej odległego, niż wielu osobom się wydaje.

Kop głębiej: odkryj najnowocześniejsze rozwiązania martech za darmo – online w przyszłym tygodniu!

Zdobądź MarTech! Codziennie. Bezpłatny. W Twojej skrzynce odbiorczej.

Zobacz warunki.

Powiązane historie

Nowość w MarTechu