Navigare nell'etica dell'IA nel reclutamento

Pubblicato: 2023-07-21Il mondo del reclutamento ha subito una trasformazione significativa negli ultimi anni grazie ai rapidi progressi nella tecnologia dell'intelligenza artificiale (AI).

L'intelligenza artificiale ha rivoluzionato molti aspetti del processo di reclutamento, offrendo strumenti e soluzioni innovativi che automatizzano i flussi di lavoro, migliorano il processo decisionale e migliorano l'esperienza del candidato.

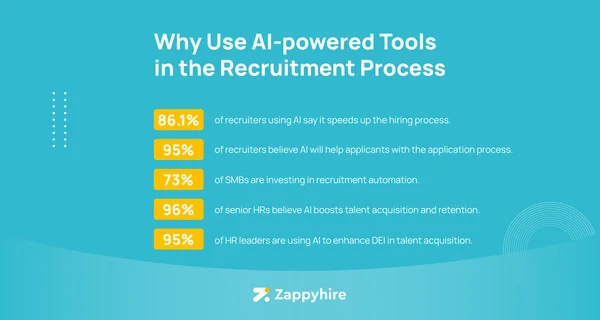

L'impatto dell'intelligenza artificiale sul reclutamento ha alcune statistiche impressionanti.

Uno sbalorditivo 96% dei professionisti senior delle risorse umane ritiene che l'intelligenza artificiale migliorerà notevolmente l'acquisizione e la fidelizzazione dei talenti. Inoltre, l'86,1% dei reclutatori che utilizzano l'intelligenza artificiale conferma che accelera il processo di assunzione, il che dimostra la sua efficienza e le sue capacità di risparmio di tempo.

L'adozione dell'intelligenza artificiale nel reclutamento è diffusa, con almeno il 73% delle aziende che investe nell'automazione del reclutamento per ottimizzare i propri sforzi di acquisizione di talenti. Questa tendenza è rafforzata dall'85% dei reclutatori che ritiene che l'IA sia utile nelle loro pratiche di reclutamento.

Tuttavia, mentre abbracciamo questa tecnologia trasformativa, dobbiamo anche affrontare l'etica dell'IA nel reclutamento. Sebbene l'intelligenza artificiale offra numerosi vantaggi, pone anche sfide e potenziali insidie che devono essere affrontate con attenzione.

In questo blog esploreremo le complessità dell'IA nel reclutamento, considereremo il suo potenziale ed evidenzieremo l'importanza delle considerazioni etiche nella sua implementazione.

Fonte: Zappyhire

Prima di approfondire le implicazioni etiche, stabiliamo innanzitutto una chiara definizione e portata dell'intelligenza artificiale nel reclutamento.

Cos'è l'intelligenza artificiale nel reclutamento?

L'intelligenza artificiale nel reclutamento si riferisce all'uso di algoritmi di apprendimento automatico (ML), elaborazione del linguaggio naturale (NLP) e altre tecniche di intelligenza artificiale per automatizzare o aumentare le varie fasi del processo di assunzione. Si chiama anche software di automazione del reclutamento.

Qual è la portata dell'intelligenza artificiale nel reclutamento?

Nel contesto dell'occupazione, questo potrebbe essere qualsiasi cosa, da un algoritmo che consiglia i candidati in base alle tue esigenze specifiche (ad esempio, "Voglio qualcuno che ha lavorato in aziende come Google o Amazon") fino al software per colloqui video o ai chatbot che selezionano i candidati per te ponendo loro domande sulla loro esperienza passata e sul set di competenze.

Il software di reclutamento basato sull'intelligenza artificiale sta diventando sempre più comune nei dipartimenti delle risorse umane, comunemente indicato come "tecnologia delle risorse umane" o "tecnologia dei talenti". Diamo un'occhiata ad alcuni di loro.

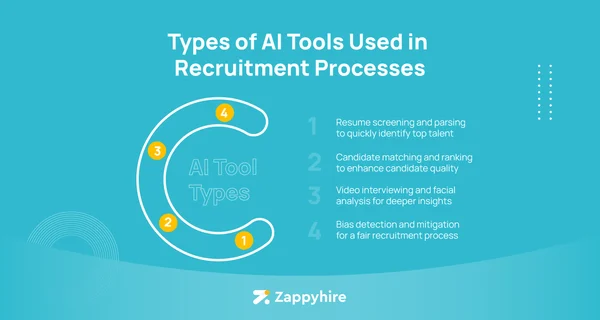

Tipi di strumenti di intelligenza artificiale utilizzati nei processi di reclutamento

Dallo screening del curriculum e l'abbinamento dei candidati ai colloqui video e al rilevamento dei pregiudizi, gli strumenti di intelligenza artificiale hanno la capacità di automatizzare le attività di reclutamento che richiedono tempo e ottimizzare l'esperienza di assunzione complessiva per tutti, inclusi i candidati.

1. Riprendere lo screening e l'analisi

Una delle fasi iniziali del reclutamento prevede la revisione di un vasto numero di curriculum. Gli strumenti di screening e analisi dei curriculum basati sull'intelligenza artificiale possono analizzare rapidamente i curriculum, estrarre informazioni pertinenti e identificare i migliori candidati in base ai criteri predefiniti.

Questo riduce il tuo onere, permettendoti di concentrarti su aspetti più strategici dell'acquisizione di talenti.

2. Corrispondenza e graduatoria dei candidati

Gli strumenti di corrispondenza e classificazione dei candidati basati sull'intelligenza artificiale utilizzano algoritmi che prendono in considerazione vari fattori, come competenze, esperienza e adattamento culturale, per identificare i candidati più adatti per ciascun ruolo.

Ciò consente di risparmiare tempo e migliora la qualità dei candidati che incontrerai.

3. Intervista video e analisi facciale

I colloqui video hanno guadagnato popolarità negli ultimi anni, offrendo comodità a candidati e reclutatori.

Gli strumenti per colloqui video basati sull'intelligenza artificiale vanno oltre la semplice videoconferenza analizzando le espressioni facciali, il tono della voce e il linguaggio del corpo per fornire informazioni più approfondite sull'idoneità di un candidato per un ruolo.

Tuttavia, è importante bilanciare i vantaggi di tale analisi con i problemi di privacy e il potenziale pregiudizio.

4. Rilevamento e mitigazione dei bias

L'intelligenza artificiale è abile nell'eliminare i pregiudizi nel reclutamento rimuovendo la soggettività umana dal processo decisionale. Gli algoritmi ML possono rilevare e ridurre i pregiudizi nelle descrizioni delle mansioni, nelle valutazioni dei candidati e nei processi di selezione.

Tuttavia, mentre l'intelligenza artificiale è sicuramente sulla strada per ridurre i pregiudizi nel reclutamento, gli esseri umani lo influenzano ancora. Eliminare completamente i pregiudizi è un obiettivo lontano. Usare eticamente l'IA nel reclutamento significa promuovere l'equità e l'inclusività e lottare per una forza lavoro diversificata: un lavoro in corso per l'IA.

Fonte: Zappyhire

Comprensione del pregiudizio nei sistemi di reclutamento dell'IA

Il pregiudizio algoritmico è una preoccupazione fondamentale nei sistemi di reclutamento dell'IA in quanto può perpetuare le disuguaglianze e portare a risultati discriminatori. Esamina le fonti e le manifestazioni di pregiudizio per affrontare i tuoi problemi in modo efficace.

Parliamo di due aspetti chiave del bias nei sistemi di reclutamento AI: dati di addestramento distorti e le diverse manifestazioni di bias.

Dati di addestramento distorti e perpetuazione delle disuguaglianze

Una delle principali fonti di bias nei sistemi di reclutamento AI sono i dati di training distorti.

Gli algoritmi di intelligenza artificiale imparano dai dati storici, che riflettono i pregiudizi e le disuguaglianze sociali esistenti. Se i dati di addestramento rappresentano prevalentemente un particolare gruppo demografico o mostrano modelli iniqui, il sistema di intelligenza artificiale può perpetuare tali pregiudizi nei suoi processi decisionali.

Ad esempio, se un set di dati utilizzato per addestrare un sistema di intelligenza artificiale comprende principalmente curriculum da un determinato gruppo demografico, l'algoritmo potrebbe inavvertitamente favorire i candidati di quel gruppo demografico, portando all'esclusione di altri individui qualificati. Assicurati di lavorare con dati di formazione diversi e rappresentativi per mitigare i pregiudizi.

Manifestazioni di bias nei sistemi di intelligenza artificiale

Devi essere consapevole dei vari modi in cui si manifestano i pregiudizi nei sistemi di reclutamento in modo da affrontarli in modo efficace. Esploriamo due manifestazioni comuni: pregiudizi educativi e geografici e pregiudizi linguistici e di parole chiave.

1. Pregiudizi educativi e geografici: esclusioni non intenzionali

I sistemi di intelligenza artificiale addestrati su dati distorti possono presentare pregiudizi educativi e geografici. Esattamente come nell'esempio precedente, se i dati formativi sono costituiti prevalentemente da candidati provenienti da prestigiose università o specifiche aree geografiche, il sistema AI potrebbe inavvertitamente favorire candidati con un background formativo simile o provenienti da determinate aree. Ciò può comportare l'esclusione di altri candidati idonei da percorsi formativi alternativi o altre sedi.

Le esclusioni involontarie basate su pregiudizi educativi e geografici ostacolano la diversità e limitano il tuo potenziale pool di talenti. Assicurati che i tuoi sistemi di intelligenza artificiale considerino un'ampia gamma di background educativi e posizioni geografiche per prevenire la discriminazione.

2. Distorsioni del linguaggio e delle parole chiave: discriminazione inconscia

I pregiudizi della lingua e delle parole chiave sono altre due manifestazioni di pregiudizi nei sistemi di reclutamento dell'IA. Gli algoritmi di intelligenza artificiale possono imparare ad associare determinate parole o frasi con attributi candidati desiderabili o indesiderabili, il che può portare a una discriminazione inconscia.

Ad esempio, se determinate parole chiave o frasi sono associate a sesso, età o razza nei dati di allenamento, il sistema di intelligenza artificiale potrebbe inavvertitamente favorire o penalizzare i candidati in base a questi fattori.

Affrontare i pregiudizi linguistici e delle parole chiave richiede un attento esame dei dati di addestramento e della progettazione algoritmica. Fai tutto il possibile per garantire che il tuo sistema di intelligenza artificiale non discrimini in base a caratteristiche protette e che le valutazioni basate sulla lingua siano obiettive.

Per ridurre i pregiudizi nei sistemi di reclutamento dell'IA, adottare le migliori pratiche come dati di formazione diversi e rappresentativi, regolari controlli sui pregiudizi e valutazioni dei sistemi di intelligenza artificiale, oltre a migliorare la trasparenza e la spiegabilità.

Le organizzazioni promuovono l'equità, l'inclusività e le pari opportunità nel processo di reclutamento identificando e affrontando attivamente i pregiudizi.

Leggi di più: Come navigare nell'etica per l'IA generativa nel mondo delle risorse umane →

Etica dell'intelligenza artificiale nel reclutamento

L'uso dell'intelligenza artificiale per il reclutamento non è intrinsecamente immorale, ma può portare a pregiudizi involontari. Alcuni studi suggeriscono che gli strumenti di reclutamento basati sull'intelligenza artificiale sono più efficaci di quelli tradizionali e, sebbene a prima vista possano essere più efficienti dei reclutatori umani, presentano anche degli svantaggi.

Una preoccupazione significativa è che, poiché gli strumenti di intelligenza artificiale si basano su set di dati che riflettono pregiudizi sociali esistenti, perpetueranno anche tali pregiudizi nel loro processo decisionale.

Impatto negativo su diversità e inclusione

Il pregiudizio può derivare da dati di addestramento distorti, algoritmi o interpretazioni dell'output.

Supponiamo che uno strumento di reclutamento basato sull'intelligenza artificiale sia addestrato sui dati storici di un'azienda tecnologica. L'azienda ha una lunga storia di assunzione di candidati provenienti da rinomate università. Questa tendenza è incorporata nei dati storici.

Questo pregiudizio può essere mantenuto involontariamente quando lo strumento AI valuta i candidati. Come addestrato, l'algoritmo dà la priorità ai candidati delle università predefinite nel suo database e trascura altri candidati qualificati con competenze ed esperienza pertinenti.

Il pregiudizio deriva dai dati di formazione distorti e si manifesta sotto forma di favoritismi. Sebbene progettato per migliorare il processo di assunzione, l'algoritmo AI perpetua inavvertitamente i pregiudizi esistenti, divulgando una valutazione del candidato equa e inclusiva.

Sfide di trasparenza e spiegabilità

I sistemi di intelligenza artificiale sono complessi e difficili da interpretare, il che rende difficile per candidati e reclutatori capire perché vengono prese determinate decisioni. La mancanza di trasparenza erode la fiducia nel processo di assunzione e solleva preoccupazioni circa l'equità e la responsabilità.

Chiarezza nel processo decisionale algoritmico

Per affrontare le sfide della trasparenza, fornire spiegazioni chiare sul modo in cui funzionano gli algoritmi di intelligenza artificiale, i fattori che influenzano il processo decisionale e i criteri utilizzati per valutare i candidati. La comunicazione aperta e la trasparenza consentono ai candidati di comprendere e fidarsi del processo di reclutamento guidato dall'intelligenza artificiale. In effetti, il 48% delle persone in cerca di lavoro afferma che non ottenere un feedback adeguato è uno degli aspetti più frustranti della candidatura per un lavoro.

Problemi di privacy e protezione dei dati

Devi raccogliere e archiviare i dati sensibili dei candidati quando utilizzi l'intelligenza artificiale per reclutare talenti. Ciò solleva preoccupazioni in merito alla privacy e alla protezione dei dati. Devi assicurarti di avere il consenso informato di ciascun candidato e che le sue informazioni siano archiviate in modo sicuro e protette da accessi non autorizzati o uso improprio. La conformità alle normative sulla protezione dei dati pertinenti, come il GDPR, è fondamentale per salvaguardare la privacy dei candidati.

Sicurezza dei dati e uso improprio

Adotta solide misure di sicurezza dei dati per proteggere le informazioni sui candidati. Ciò include l'implementazione di protocolli di crittografia, controlli di accesso e regolari controlli di sicurezza. Inoltre, è necessario stabilire politiche chiare sulla conservazione dei dati e garantire che i dati dei candidati vengano utilizzati solo a fini di reclutamento e non condivisi con terze parti senza consenso.

Quali sono le migliori pratiche per l'uso etico dell'IA nel reclutamento?

Se utilizzato correttamente, il software di reclutamento apporta numerosi vantaggi al tuo processo. In effetti, l'integrazione dell'intelligenza artificiale nel reclutamento è stata molto utile nell'approvvigionamento di candidati, con il 58% dei reclutatori che ha trovato l'intelligenza artificiale preziosa in questo senso, seguito da vicino dallo screening dei candidati al 56% e dal nutrimento dei candidati al 55%.

La percezione positiva dell'IA va oltre i reclutatori, poiché l'80% dei dirigenti ritiene che l'IA abbia il potenziale per migliorare la produttività e le prestazioni all'interno delle proprie organizzazioni.

Anche nella sua prima fase di adozione, il software di reclutamento basato sull'intelligenza artificiale ha mostrato risultati notevoli. I primi utenti hanno registrato una significativa riduzione del costo per schermo, con un incredibile calo del 75%.

Anche i tassi di turnover hanno registrato un notevole calo del 35%. Questi risultati, osservati già nel 2017, forniscono una chiara evidenza degli effetti positivi dell'implementazione dell'IA nel processo di reclutamento.

Ora, diamo un'occhiata ad alcune best practice per garantire equità, accuratezza e trasparenza nel processo di reclutamento.

Garantire diversi dati di formazione

Gli algoritmi di intelligenza artificiale imparano dai dati su cui vengono addestrati. Per evitare che i pregiudizi vengano perpetuati, assicurati che i tuoi dati di addestramento siano rappresentativi del pool di candidati. Affrontare attivamente la sottorappresentazione e raccogliere dati da diverse fonti per creare un sistema di reclutamento basato sull'IA più inclusivo ed equo.

Condurre audit regolari dei sistemi di intelligenza artificiale per il rilevamento dei bias

Per mantenere l'integrità dei sistemi di reclutamento dell'IA, istituire audit e valutazioni regolari per rilevare eventuali pregiudizi. Queste valutazioni aiutano a identificare e affrontare i pregiudizi sistemici per migliorare l'equità complessiva del processo di assunzione. Monitorando e valutando continuamente i sistemi di intelligenza artificiale, confermi che sono in linea con gli standard etici e forniscono risultati imparziali.

Migliorare la trasparenza e la spiegabilità

Impiega modelli e algoritmi di intelligenza artificiale interpretabili che forniscono spiegazioni chiare per le decisioni che prendono. Comunicando il ruolo dell'intelligenza artificiale nel processo di reclutamento e i fattori considerati nel processo decisionale, aiuti i candidati e i selezionatori a comprendere e fidarsi della tecnologia.

Quando i candidati ricevono notifiche o feedback basati su valutazioni AI, il ragionamento alla base di tali decisioni dovrebbe essere spiegato in modo comprensibile e significativo per loro. Questa trasparenza aiuta i candidati a navigare nel processo di reclutamento e crea fiducia nel sistema di intelligenza artificiale.

Salvaguardare la privacy e la protezione dei dati

Poiché l'intelligenza artificiale si basa sui dati dei candidati, devi dare la priorità alla privacy e alla protezione dei dati. Garantire la conformità alle normative sulla protezione dei dati pertinenti, come il GDPR o il California Consumer Privacy Act (CCPA).

Implementa solide misure di sicurezza per proteggere le informazioni sui candidati da accessi, usi o violazioni non autorizzati. Salvaguardando la privacy, puoi creare fiducia nell'uso dell'intelligenza artificiale nel reclutamento.

Garantire responsabilità e responsabilità

Per promuovere l'implementazione responsabile dell'IA nel reclutamento, stabilire linee guida chiare per l'utilizzo dell'IA e il processo decisionale. Designare individui o team responsabili delle prestazioni del sistema di reclutamento AI e del rispetto delle pratiche etiche.

Il monitoraggio e la governance regolari dei sistemi di intelligenza artificiale contribuiranno a garantire la responsabilità, mitigare i potenziali rischi e promuovere una condotta etica durante tutto il processo di assunzione.

Bilanciare l'efficienza dell'IA e il giudizio umano

Mentre l'IA può migliorare l'efficienza nei processi di reclutamento, devi trovare un equilibrio tra l'efficienza dell'IA e il giudizio umano. L'intelligenza artificiale dovrebbe essere vista come uno strumento per supportare e aumentare il nostro processo decisionale, non come un suo sostituto. Incorporare la supervisione e la revisione umane per garantire che le scelte basate sull'intelligenza artificiale siano in linea con i valori e l'etica dell'organizzazione.

Il giudizio umano porta qualità essenziali come l'empatia, l'intuizione e la comprensione del contesto nel processo di reclutamento. In effetti, un po' di know-how umano combinato con un sistema di intelligenza artificiale è tutto ciò che serve per garantire un processo di reclutamento rapido e basato sui dati.

Un sostanziale 68% dei reclutatori ritiene che l'utilizzo dell'intelligenza artificiale nel processo di reclutamento possa effettivamente rimuovere pregiudizi involontari per lavorare verso una valutazione obiettiva dei candidati.

Fonte: Zappyhire

Aumenta il processo decisionale umano con l'intelligenza artificiale per potenziare i reclutatori

L'intelligenza artificiale porta sul tavolo l'automazione e le intuizioni basate sui dati, ma devi riconoscere il valore del processo decisionale umano e incorporarlo in modo efficace.

"Abbracciare il potere della collaborazione uomo/IA nel processo di reclutamento è la chiave per sbloccare una nuova era di acquisizione di talenti".

Jyothis KS

Co-fondatore, Zappyhire

Convinto sostenitore del processo decisionale "umano al primo posto", Jyothis ribadisce: "Insieme, possiamo combinare le intuizioni e le capacità dell'intelligenza artificiale con il tocco umano per scoprire il potenziale nascosto, prendere decisioni imparziali e creare team diversi ed eccezionali".

Esploriamo alcuni aspetti importanti da tenere a mente.

Incorporare la supervisione umana e la revisione nei processi di reclutamento dell'IA

La capacità dell'intelligenza artificiale di automatizzare attività ripetitive, analizzare grandi quantità di dati, identificare modelli e fornire approfondimenti basati sui dati ti consente di fare scelte più informate risparmiando tempo prezioso.

Tuttavia, l'intelligenza artificiale non è un sostituto del giudizio umano. Devi incorporare la supervisione e la revisione umana per garantire l'equità, mitigare i pregiudizi e interpretare contesti complessi che gli algoritmi di intelligenza artificiale potrebbero non comprendere appieno. Il tocco umano consente una comprensione più profonda dei candidati perché consideriamo i fattori soggettivi e forniamo l'empatia necessaria che potrebbe mancare all'IA.

Ecco come trovare il giusto equilibrio tra tecnologia AI e giudizio umano.

1. Stabilire un flusso di lavoro collaborativo

Incorpora un flusso di lavoro collaborativo in cui la tecnologia AI e le competenze umane vanno di pari passo. Affida ai tuoi reclutatori umani il compito di rivedere le raccomandazioni e le decisioni dell'IA per certificare l'allineamento con i valori organizzativi, gli standard etici e i requisiti legali.

2. Incoraggiare l'apprendimento e il miglioramento continui

Promuovi una cultura di apprendimento e miglioramento continuo valutando regolarmente le prestazioni dei sistemi di intelligenza artificiale. Ciò ti consente di identificare e correggere eventuali pregiudizi e migliorare l'accuratezza e l'equità dei suggerimenti generati dall'intelligenza artificiale.

3. Stabilire linee guida chiare per l'utilizzo dell'IA

Definisci linee guida e politiche chiare per l'utilizzo dell'IA nei tuoi processi di reclutamento. Specificare i ruoli e le responsabilità della tecnologia AI, dei selezionatori e delle parti interessate coinvolte. Questa chiarezza garantisce che l'IA sia utilizzata in modo etico e in linea con gli obiettivi organizzativi.

4. Designare individui o team responsabili

Per supervisionare i sistemi di reclutamento dell'IA e rispettare le pratiche etiche, questi membri del team dovrebbero avere una profonda conoscenza della tecnologia dell'IA, dei suoi limiti e dei suoi potenziali rischi.

AI e giudizio umano: una relazione sinergica

Man mano che il panorama del reclutamento cambia, devi imparare come la tua azienda navigherà con attenzione e perspicacia nell'intersezione tra intelligenza artificiale e giudizio umano. Attingendo dal meglio di entrambi i mondi, puoi elevare le tue pratiche di reclutamento e avere un impatto positivo sui candidati con cui interagisci, il che aumenta anche il tuo marchio del datore di lavoro.

In definitiva, l'integrazione riuscita dell'intelligenza artificiale e del giudizio umano pone le basi per un processo di reclutamento più efficiente, inclusivo ed efficace.

Le assunzioni intelligenti invocano utilizzando la tecnologia intelligente. Scopri come i chatbot per il reclutamento semplificano la comunicazione con i potenziali candidati e alzano il livello in un mercato del lavoro competitivo.