Quel avenir pour genAI ? Le cycle de battage médiatique de Gartner

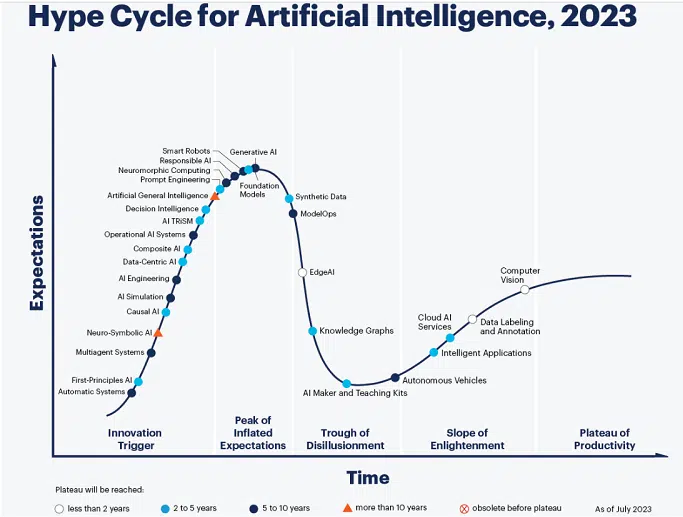

Publié: 2023-09-21Il n’est surprenant pour personne que l’IA générative et les modèles fondamentaux qui la soutiennent se trouvent actuellement au sommet de ce que Gartner appelle « le pic des attentes exagérées » dans la dernière itération du « Gartner Hype Cycle for Artificial Intelligence ». Cela signifie qu’ils sont au bord du précipice qui pourrait les plonger dans le « creux de la désillusion ».

Nous avons discuté avec Afraz Jaffri, analyste directeur chez Gartner spécialisé dans l'analyse, la science des données et l'IA, sur la manière dont nous devrions interpréter la situation. L'interview a été éditée pour des raisons de longueur et de clarté.

Q : Vous prévoyez qu'il faudra deux à cinq ans pour que les modèles de base, et cinq à dix ans pour que l'IA générative atteigne le « plateau de productivité ». C'est basé sur quoi ?

R : C'est à ce moment-là que nous pouvons assister à une véritable adoption, non seulement parmi un nombre restreint d'entreprises, ce qui sera probablement beaucoup plus rapide, mais à tous les niveaux des organisations, principalement sous la forme d'applications packagées. Chaque logiciel comportera une sorte de fonctionnalité d’IA générative, mais les gains de productivité réels issus de ces fonctionnalités prendront plus de temps à être compris. C'est une course pour tout le monde pour proposer un produit ou une fonctionnalité d'IA générative dans son logiciel ; dans tous ces cas, les bénéfices mettront plus de temps à se concrétiser et à être également mesurés.

Les modèles de fondation couvrent un large spectre ; pas seulement les grands modèles linguistiques, mais aussi les modèles d'images et de vidéos. C'est pourquoi le temps nécessaire pour atteindre un plateau sera plus long. C'est un seau de toutes sortes de modèles.

Creusez plus profondément : pourquoi nous nous soucions de l'IA dans le marketing

Q : Il est possible d’imaginer des choses qui pourraient perturber grandement l’IA générative. L’un d’entre eux est la réglementation : il existe de réelles inquiétudes, notamment en Europe, concernant les grands modèles linguistiques qui récupèrent les données personnelles. L'autre concerne le droit d'auteur. Avez-vous pris en compte ce type de perturbations possibles ici ?

R : Oui, ils font partie de la réflexion. Le premier problème est en fait l’aspect confiance. Indépendamment des réglementations externes, il existe toujours un sentiment fondamental selon lequel il est très difficile de contrôler les résultats des modèles et de garantir que les résultats sont réellement corrects. C'est un gros obstacle. Comme vous l'avez mentionné, il y a aussi le flou autour de la réglementation. Si en Europe les modèles sont soumis à une réglementation importante, ils pourraient même ne pas être disponibles ; nous avons déjà vu ChatGPT supprimé là-bas depuis un certain temps. Si les grandes entreprises se rendent compte qu'il est trop difficile de s'y conformer, elles pourraient tout simplement retirer leurs services de cette région.

Il y a aussi le côté juridique. Ces modèles sont basés, comme vous l'avez dit, sur des données qui incluent des données protégées par le droit d'auteur extraites du Web. Si les fournisseurs de ces données commencent à demander un rachat approprié, cela aura également un impact sur le niveau futur d’utilisation de ces modèles. Ensuite, il y a le côté sécurité. Dans quelle mesure pouvez-vous sécuriser ces modèles contre des éléments tels que les attaques. Il y a certainement des vents contraires ici pour naviguer.

Q : Nous entendons beaucoup parler de « l’humain dans le circuit ». Avant de diffuser quelque chose créé par l’IA générative à un public, vous devez faire l’objet d’un examen et d’une approbation humaine. Mais l’un des avantages de genAI réside dans la rapidité et l’ampleur de sa créativité. Comment les humains peuvent-ils suivre le rythme ?

R : La vitesse et l’échelle sont là pour être utilisées par les humains pour faire les choses dont ils ont besoin. Il est là pour aider les gens qui, par exemple, ont besoin de parcourir 10 documents pour obtenir une réponse à quelque chose ; maintenant, ils peuvent le faire en une minute. En raison du problème de confiance, ce sont les types de tâches les plus utiles pour lesquelles utiliser un modèle de langage.

Q : Si l’IA responsable est à cinq à dix ans du plateau, il semble que vous prédisiez un parcours semé d’embûches.

R : Le monde de la réglementation et les autres systèmes sont inconnus ; et même lorsqu’elles seront formalisées et connues, il y aura des réglementations différentes selon les zones géographiques. La nature innée de ces modèles est qu’ils ont tendance à ne pas être sûrs. Il faudra du temps pour apprendre à être capable de contrôler cela. Comment vérifier qu’un modèle sera sûr ? Comment auditer la conformité d’un modèle ? Pour la sécurité? Les meilleures pratiques sont difficiles à trouver ; chaque organisation adopte sa propre approche. Oubliez l’IA générative, d’autres modèles d’IA, ceux utilisés par les organisations depuis un certain temps, font encore des erreurs, présentent encore des biais.

Q : Comment les gens devraient-ils se préparer au creux imminent de la désillusion ?

R : Les organisations suivront des trajectoires différentes dans leur expérience de l’IA générative, cela ne signifie donc pas nécessairement qu’une organisation doit tomber dans le creux. Cela se produit généralement lorsque les attentes ne sont pas gérées. Si vous commencez par examiner certains cas d'utilisation ciblés, certains éléments de mise en œuvre ciblés et que vous disposez de bons indicateurs de réussite, ainsi que d'investissements dans la gestion et l'organisation des données ; bonne gouvernance, bonnes politiques ; Si vous combinez tout cela avec un récit pratique sur ce que les modèles peuvent faire, alors vous avez contrôlé le battage médiatique et vous risquez moins de tomber dans le creux.

Q : Diriez-vous que le cycle de battage médiatique de l’IA est plus rapide que d’autres que vous avez examinés ?

R : Le cycle de battage médiatique de l’IA a tendance à être orienté vers les innovations qui évoluent plus rapidement sur la courbe – et elles ont également tendance à avoir plus d’impact dans ce qu’elles peuvent faire. À l’heure actuelle, c’est au centre des initiatives de financement des sociétés de capital-risque. C'est un domaine très central, également dans le domaine de la recherche. Beaucoup de ces choses viennent du monde universitaire, qui est très actif dans ce domaine.

Q : Enfin, l’AGI, ou intelligence générale artificielle (IA qui reproduit l’intelligence humaine). Cela devrait arriver dans dix ans ou plus. Êtes-vous en train de couvrir vos paris parce que cela pourrait ne pas être possible du tout ?

R : Oui. Nous avons un marqueur qui est « obsolète avant le plateau ». Certains prétendent que cela n'arrivera jamais, mais nous disons que cela prendra plus de 10 ans parce qu'il y a tellement d'interprétations différentes de ce qu'est réellement l'AGI. De nombreux chercheurs respectés affirment que nous sommes sur la voie qui nous mènera à l'AGI, mais de nombreuses autres percées et innovations sont nécessaires pour voir à quoi ressemble réellement cette voie. Nous pensons que c’est quelque chose de plus lointain que ce que beaucoup de gens pensent.

Creusez plus profondément : découvrez gratuitement des solutions martech de pointe – en ligne la semaine prochaine !

Obtenez MarTech ! Tous les jours. Gratuit. Dans votre boîte de réception.

Voir les conditions.

Histoires connexes

Nouveau sur MarTech