Ne manquez pas les nouvelles de l'industrie des médias sociaux de demain

Publié: 2023-04-13Parmi les principales préoccupations concernant la prise de contrôle d'Elon Musk sur Twitter, il y a l'assouplissement perçu des réglementations passées concernant les discours de haine, la désinformation et d'autres éléments préoccupants.

Musk, qui soutient fermement l'autorisation de toutes sortes de discours, qu'ils soient personnellement répréhensibles ou non, a supervisé le rétablissement de dizaines de milliers de comptes qui étaient auparavant interdits par la direction de Twitter, tandis qu'il a également supprimé les restrictions conçues pour freiner la désinformation COVID, annulé les étiquettes d'avertissement sur le contenu des médias d'État chinois et russes, tout en faisant lui-même la promotion de diverses théories du complot auprès de ses 134 millions de followers.

Ce sont des changements comme ceux-ci qui auraient vu de nombreux annonceurs Twitter éviter l'application, en raison de préoccupations concernant une association potentielle avec des discours de haine et du matériel offensant – mais le discours de haine est-il en fait en augmentation sur Twitter 2.0, ou est-ce le cas, comme Musk et son équipe le prétendent , réduit-il réellement en raison de processus mis à jour pour détecter et limiter ces éléments dans l'application ?

C'était le principal point de discorde de l'interview de Musk avec la BBC cette semaine, que Musk a diffusée en direct via Twitter Spaces. Dans l'ensemble, l'interview de près de deux heures n'a fourni aucun nouvel aperçu - Musk a discuté de ses licenciements précipités à l'application et de la nécessité de réduire les coûts pour sauver l'entreprise, Musk a affirmé que son chien est maintenant le PDG de Twitter, et a déclaré que Twitter pourrait éventuellement atteindre son seuil de rentabilité en quelques mois.

Mais le discours de haine, et l'impact qu'il a eu sur les annonceurs, était un point sensible clair, Musk partageant cet échange pour mettre en évidence ce qu'il perçoit comme un biais médiatique autour de cet élément.

Cette fois avec vidéo et meilleur son https://t.co/js4nTQSSh3

– Elon Musk (@elonmusk) 12 avril 2023

Bien sûr, l'expérience personnelle d'un utilisateur n'est pas indicative de l'ampleur du problème potentiel, s'il y en a un – bien que, comme indiqué, Musk et son équipe affirment que le discours de haine est en fait en baisse depuis qu'il a pris le relais de l'application.

Cela pourrait-il être vrai? Encore une fois, suite au rétablissement de tant de comptes précédemment interdits, dont beaucoup ont été fermés en raison de la violation des règles de discours de haine de la plate-forme, il semble que cet élément n'ait pas pu être réduit. Alors, comment Musk and Co. arrive-t-il alors à ces statistiques – et à quelles études la BBC fait-elle référence en ce qui concerne l'augmentation du contenu haineux ?

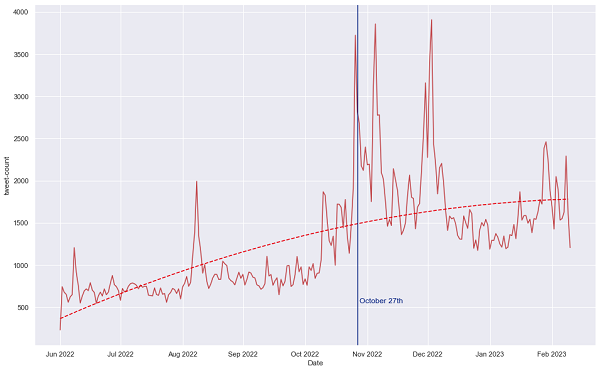

Tout d'abord, sur la recherche externe, qui montrerait que le discours de haine a augmenté. Comme indiqué dans l'interview de la BBC, l'Institute for Strategic Dialogue (ISD) a publié le mois dernier une étude qui, selon lui, montre que le volume de tweets antisémites a plus que doublé au cours des trois mois suivant la prise de contrôle de Musk sur l'application.

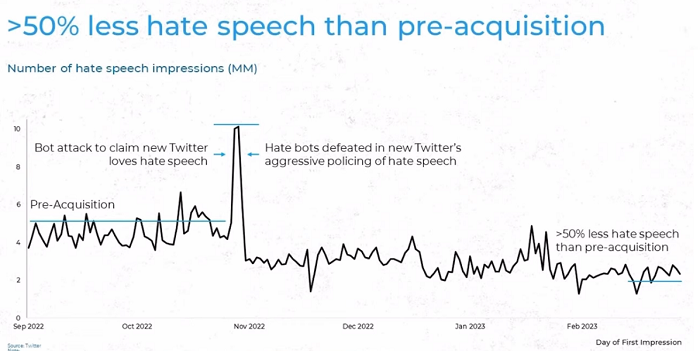

C'est un graphique assez différent de celui que Twitter a partagé - alors quelle est cette variance ici, et pourquoi les données de l'ISD montrent-elles une augmentation soutenue alors que les propres chiffres de Twitter reflètent une chute ?

À certains égards, on pourrait dire que le pic le plus important de ce graphique reflète le même incident que les données de Twitter pointent, qui, selon lui, est une augmentation des attaques de robots conçues pour discréditer le leadership de Musk en amplifiant les insultes dans l'application.

En effet, selon le rapport de l'ISD :

« Nous avons également identifié une augmentation de la création de nouveaux comptes publiant des discours de haine en corrélation avec la prise de contrôle de Musk. Au total, 3 855 comptes ayant publié au moins un Tweet antisémite ont été créés entre le 27 octobre et le 6 novembre. Cela représente plus du triple du taux de création de comptes potentiellement haineux pour la période équivalente précédant la prise de contrôle.

Cela correspond probablement à la détection des bots par Twitter, tandis que ISD note également que Twitter supprime désormais plus de contenu :

« La proportion de contenus antisémites supprimés par Twitter semble avoir augmenté depuis la prise de contrôle, 12 % des tweets antisémites étant par la suite indisponibles pour la collecte, contre 6 % avant la prise de contrôle. Cependant, cette augmentation potentielle du taux de suppression n'a pas suivi le rythme de l'augmentation du contenu antisémite global, de sorte que le discours de haine reste plus accessible sur la plate-forme qu'avant l'acquisition de Musk. ”

Les conclusions de l'ISD sont également en corrélation avec des données similaires du Center for Countering Digital Hate , qui a constaté que les insultes contre les Noirs et les transgenres ont considérablement augmenté peu de temps après que Musk a pris le relais de l'application, tandis que l'engagement sur le discours de haine a également augmenté.

"Le nombre moyen de likes, de réponses et de retweets sur les publications contenant des insultes était de 13,3 dans les semaines qui ont précédé le Twitter 2.0 de Musk . Depuis la prise de contrôle, les engagements moyens sur le contenu haineux sont passés à 49,5, selon le rapport. ”

Mais encore une fois, ces découvertes n'en étaient qu'aux premiers stades du changement, ce que Twitter admet. La question est alors de savoir si les choses ont changé depuis – et comment ont-elles changé si Twitter s'efforce de réduire les restrictions d'expression ?

Les données publiées par Twitter fournissent un contexte supplémentaire. Le mois dernier, Twitter a publié de nouvelles informations de Sprinklr qui mettent en lumière ses efforts pour lutter contre les discours de haine et la façon dont il calcule ses chiffres.

Selon Twitter :

«Sprinklr définit le discours de haine en évaluant les insultes dans le contexte nuancé de leur utilisation. Twitter a, jusqu'à présent, adopté une vision plus large de la toxicité potentielle de l'utilisation des insultes. Pour quantifier le discours de haine, Twitter et Sprinklr commencent par 300 des insultes les plus courantes en anglais. Nous comptons non seulement la fréquence à laquelle ils sont tweetés, mais aussi la fréquence à laquelle ils sont vus (impressions). Nos modèles notent les tweets insultants sur la « toxicité », la probabilité qu'ils constituent un discours de haine. »

Selon cette méthodologie, la plupart des insultes via tweet ne sont en fait pas des discours de haine, certains termes étant utilisés dans certaines communautés d'une manière qui nécessite plus de nuances dans l'évaluation que de simples données de comptage. Les termes utilisés dans la communauté noire, par exemple, peuvent ne pas être considérés comme un discours de haine dans l'ensemble, mais le seraient si vous utilisiez le suivi des mots clés.

Twitter affirme que son processus de suivi tient compte de cette considération, là où d'autres ne le font pas, et lorsque l'utilisation d'une telle terminologie est utilisée de manière haineuse, Twitter prend des mesures pour supprimer le tweet ou restreindre sa portée.

« L'analyse de Sprinklr a révélé que le discours de haine reçoit 67 % d'impressions en moins par Tweet que les Tweets insultants non toxiques. Aucun modèle n'est jamais parfait, et ce travail n'est jamais fait. Nous continuerons à lutter contre les discours de haine en incorporant d'autres langues, de nouveaux termes et des méthodologies plus précises, tout en augmentant la transparence. »

Essentiellement, Twitter dit que compter toutes les mentions d'insultes potentielles, selon ces études externes, n'est pas un moyen efficace d'en mesurer l'impact, car ce ne sont pas les mentions elles-mêmes, mais le contexte dans lequel elles sont utilisées, et par la suite, la portée qu'ils obtiennent.

Si ces considérations ne sont pas prises en compte dans une évaluation, elles ne peuvent pas être exactes, ce qui expliquerait pourquoi les données de Twitter sont si différentes des résultats obtenus via une analyse tierce.

Est-ce exact? Eh bien, sans les données comparatives complètes devant vous, c'est difficile à dire, mais le processus d'évaluation élargi a du sens, ce qui pourrait signifier qu'une analyse plus binaire de ces termes est erronée, au moins dans une certaine mesure.

Pourtant, Twitter fait également face à des milliards d'amendes en Allemagne pour ne pas avoir supprimé les discours de haine en temps opportun, conformément aux réglementations locales, et il sera intéressant de voir exactement quels exemples spécifiques les autorités allemandes fournissent dans ce cas.

Il y a donc apparemment encore des inquiétudes – mais le contexte élargi auquel Twitter fait référence, ainsi que ses efforts accrus pour restreindre les discours de haine, ont du sens.

Nous obtiendrons sans aucun doute plus de données à ce sujet au fil du temps, mais l'image globale présente une image plus nuancée que certaines conclusions ne le suggèrent.