No te pierdas las noticias de la industria de las redes sociales de mañana

Publicado: 2023-04-13Entre las principales preocupaciones en torno a la adquisición de Twitter por parte de Elon Musk se encuentra la relajación percibida de las regulaciones anteriores sobre el discurso de odio, la desinformación y otros elementos preocupantes.

Musk, quien apoya firmemente permitir todo tipo de discurso, ya sea personalmente objetable o no, supervisó el restablecimiento de decenas de miles de cuentas que anteriormente fueron prohibidas por la administración de Twitter, mientras que también eliminó las restricciones diseñadas para frenar la desinformación sobre el COVID y canceló las etiquetas de advertencia. en el contenido de los medios estatales chinos y rusos, mientras que él mismo también promueve varias teorías de conspiración a sus 134 millones de seguidores.

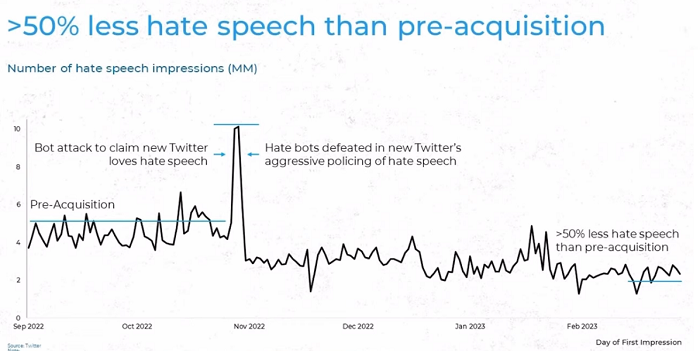

Son cambios como estos los que, según se informa, han hecho que muchos anunciantes de Twitter eviten la aplicación, debido a las preocupaciones sobre la posible asociación con el discurso de odio y el material ofensivo, pero ¿el discurso de odio está en aumento en Twitter 2.0, o es así, como afirman Musk y su equipo? , en realidad se reduce debido a los procesos actualizados para detectar y limitar tales en la aplicación?

Este fue el punto clave de discusión que surgió de la entrevista de Musk con la BBC esta semana, que Musk transmitió en vivo a través de Twitter Spaces. En general, la entrevista de casi dos horas de duración no proporcionó ninguna información nueva: Musk habló sobre sus despidos apresurados en la aplicación y la necesidad de reducir costos para salvar a la empresa, Musk afirmó que su perro ahora es el director ejecutivo de Twitter, y dijo que Twitter posiblemente podría alcanzar el punto de equilibrio en unos meses.

Pero el discurso de odio, y el impacto que ha tenido en los anunciantes, fue un claro punto doloroso, con Musk compartiendo este intercambio para resaltar lo que él percibe como un sesgo de los medios en torno a este elemento.

Esta vez con video y mejor audio https://t.co/js4nTQSSh3

– Elon Musk (@elonmusk) 12 de abril de 2023

Por supuesto, la experiencia personal de un usuario no es indicativa del alcance del problema potencial, si lo hay, aunque, como se señaló, Musk y su equipo afirman que el discurso de odio en realidad ha disminuido mucho desde que se hizo cargo de la aplicación.

¿Podría ser eso cierto? Una vez más, tras el restablecimiento de tantas cuentas previamente prohibidas, muchas de las cuales se cerraron debido a la violación de las reglas de incitación al odio de la plataforma, parece que este elemento no se puede haber reducido. Entonces, ¿cómo llegan Musk y compañía a estas estadísticas, y cuáles son los estudios a los que se refiere la BBC en relación con el aumento del contenido odioso?

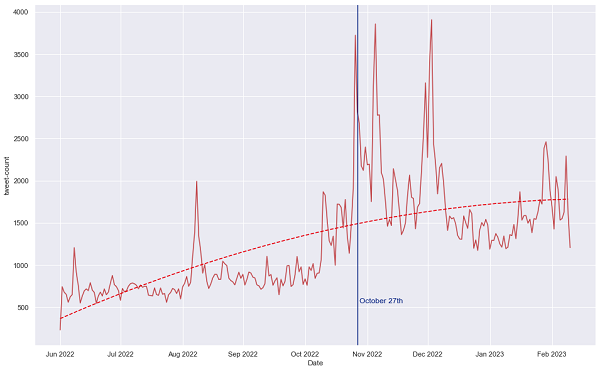

En primer lugar, sobre la investigación externa, que según se informa muestra que el discurso de odio ha aumentado. Como se mencionó en la entrevista de la BBC, el Instituto para el Diálogo Estratégico (ISD, por sus siglas en inglés) publicó un estudio el mes pasado que, según dice, muestra que el volumen de tuits antisemitas se duplicó con creces en el período de tres meses posterior a la toma de posesión de Musk en la aplicación.

Ese es un gráfico bastante diferente al que ha compartido Twitter, entonces, ¿cuál es esa variación aquí y por qué los datos de ISD muestran un aumento sostenido donde los propios números de Twitter reflejan una caída?

De alguna manera, se podría decir que el pico más grande en este gráfico refleja el mismo incidente al que apuntan los datos de Twitter, que afirma es un aumento en los ataques de bots diseñados para desacreditar el liderazgo de Musk al amplificar las calumnias en la aplicación.

De hecho, según el informe de ISD:

“También identificamos un aumento en la creación de nuevas cuentas que publican discursos de odio que se correlacionaron con la adquisición de Musk. En total, se crearon 3.855 cuentas que publicaron al menos un tuit antisemita entre el 27 de octubre y el 6 de noviembre. Esto representa más del triple de la tasa de creación de cuentas potencialmente odiosas durante el período equivalente antes de la adquisición”.

Eso probablemente se alinea con la detección de bots de Twitter, mientras que ISD también nota que Twitter ahora está eliminando más contenido:

“La proporción de contenido antisemita eliminado por Twitter parece haber aumentado en el período transcurrido desde la toma de control, con un 12 % de tuits antisemitas posteriormente no disponibles para su recopilación, en comparación con el 6 % antes de la toma de control. Sin embargo, este aumento potencial en la tasa de eliminación no ha seguido el ritmo del aumento en el contenido antisemita en general, con el resultado de que el discurso de odio sigue siendo más accesible en la plataforma que antes de la adquisición de Musk. ”

Los hallazgos de ISD también se correlacionan con datos similares del Centro para Contrarrestar el Odio Digital , que encontró que los insultos contra las personas negras y transgénero aumentaron significativamente poco después de que Musk se hizo cargo de la aplicación, mientras que la participación en el discurso de odio también aumentó.

“La cantidad promedio de Me gusta, respuestas y retuits en publicaciones con calumnias fue de 13,3 en las semanas previas al Twitter 2.0 de Musk . Desde la toma de control, el promedio de interacciones con contenido odioso ha aumentado a 49,5, según el informe. ”

Pero nuevamente, estos hallazgos se encontraban en las primeras etapas del cambio, lo que Twitter admite. Entonces, la pregunta es: ¿han cambiado las cosas desde entonces? ¿Y cómo han cambiado si Twitter está trabajando para reducir las restricciones de expresión?

Los datos publicados por Twitter proporcionan un contexto adicional. El mes pasado, Twitter publicó nuevas ideas de Sprinklr que arrojan más luz sobre sus esfuerzos para frenar el discurso de odio y cómo calcula sus cifras.

Según Twitter:

“Sprinklr define el discurso de odio al evaluar los insultos en el contexto matizado de su uso. Twitter, hasta este punto, ha tomado una visión más amplia de la toxicidad potencial del uso de insultos. Para cuantificar el discurso de odio, Twitter y Sprinklr comienzan con 300 de los insultos más comunes en inglés. Contamos no solo con qué frecuencia se tuitean, sino también con qué frecuencia se ven (impresiones). Nuestros modelos califican los Tweets insultantes sobre 'toxicidad', la probabilidad de que constituyan un discurso de odio”.

De acuerdo con esta metodología, la mayor parte del uso de insultos a través de tweets en realidad no es un discurso de odio, con ciertos términos que se usan dentro de ciertas comunidades de una manera que requiere más matices en la evaluación que los simples datos de conteo. Los términos utilizados en la comunidad negra, por ejemplo, pueden no verse como un discurso de odio en general, pero se considerarían tales si estuviera utilizando el seguimiento de palabras clave.

Twitter afirma que su proceso de seguimiento tiene en cuenta esta consideración, donde otros no lo hacen, y cuando el uso de dicha terminología se usa de manera odiosa, Twitter toma medidas para eliminar el tweet o restringir su alcance.

“El análisis de Sprinklr encontró que el discurso de odio recibe un 67 % menos de impresiones por Tweet que los Tweets con insultos no tóxicos. Ningún modelo es perfecto, y este trabajo nunca termina. Continuaremos combatiendo el discurso de odio incorporando otros lenguajes, nuevos términos y metodologías más precisas, al mismo tiempo que aumentamos la transparencia”.

Esencialmente, Twitter dice que contar todas las menciones de posibles calumnias, según estos estudios externos, no es un medio efectivo para medir el impacto de tales, porque no son las menciones en sí mismas, sino el contexto en el que se usan y, posteriormente, el alcance que obtienen.

Si estas consideraciones no se tienen en cuenta en ninguna evaluación, no puede ser precisa, lo que explicaría por qué los datos de Twitter son tan diferentes a los hallazgos a través del análisis de terceros.

¿Es eso correcto? Bueno, sin los datos comparativos completos ante usted, es difícil decirlo, pero el proceso de evaluación ampliado tiene sentido, lo que podría significar que un análisis más binario de dichos términos es defectuoso, al menos hasta cierto punto.

Aún así, Twitter también enfrenta miles de millones en multas en Alemania por no eliminar el discurso de odio de manera oportuna, según las regulaciones locales, y será interesante ver exactamente qué ejemplos específicos brindan las autoridades alemanas en ese caso.

Entonces, aparentemente, todavía hay algunas preocupaciones, pero el contexto ampliado al que se refiere Twitter, junto con sus mayores esfuerzos para restringir el discurso de odio, tiene algún sentido.

Sin duda obtendremos más datos sobre esto a medida que pase el tiempo, pero el panorama general presenta una imagen más matizada de lo que algunos hallazgos pueden sugerir.