genAI の将来はどうなるでしょうか? ガートナーのハイプ サイクル

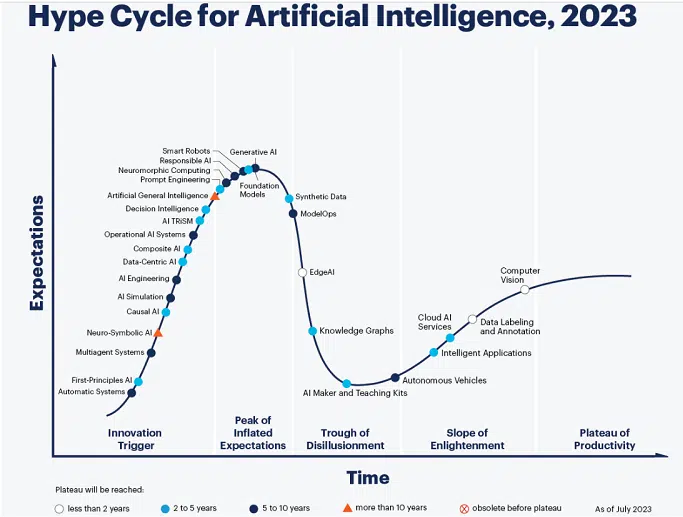

公開: 2023-09-21生成 AI とそれをサポートする基礎モデルが現在、ガートナーが「人工知能に対するガートナーのハイプ サイクル」の最新版の中で「膨らんだ期待の頂点」と呼ぶものの頂点に位置していることは、誰にとっても驚くべきことではありません。 それは、彼らが「幻滅の谷」に落ちかねない崖の上でよろめいていることを意味する。

分析、データ サイエンス、AI に重点を置く Gartner のディレクター アナリスト、Afraz Jaffri 氏に、状況をどのように解釈すべきかについて話を聞きました。 インタビューは長さと明瞭さのために編集されています。

Q:あなたは、基礎モデルが「生産性のプラトー」に達するまでに 2 ~ 5 年、生成 AI が到達するまでに 5 ~ 10 年かかると予測しています。 それは何を根拠にしているのでしょうか?

A:これは、選択された数の企業の間だけでなく、おそらくはるかに早く行われるであろう、すべてのレベルの組織の間で、主にパッケージ化されたアプリケーションの形で、実際の導入が見られる時期です。 すべてのソフトウェアには何らかの生成 AI 機能が組み込まれていますが、それらの機能による実際の生産性の向上を理解するにはさらに時間がかかるでしょう。 生成的な AI 製品や機能をソフトウェア内にリリースすることは、誰もが競う競争です。 いずれの場合も、メリットが実現し、測定されるまでにはさらに長い時間がかかります。

基礎モデルは幅広い範囲をカバーします。 大規模な言語モデルだけでなく、画像やビデオのモデルも含まれます。 そのため、停滞期に至るまでの時間が長くなるのです。 あらゆる種類のモデルが入ったバケツです。

さらに詳しく: マーケティングにおいて AI を重視する理由

Q:生成型 AI にとって非常に破壊的となる可能性のある事柄を想像することは可能です。 1 つは規制です。特にヨーロッパでは、大規模な言語モデルが個人データをスクレイピングすることについて、大きな懸念があります。 もう一つは著作権に関するものです。 そういった種類の混乱の可能性をここで考慮に入れましたか?

A:はい、それらは思考の一部です。 最初の問題は実際には信頼の側面です。 外部規制に関係なく、モデルの出力を制御し、出力が実際に正しいことを保証するのは非常に難しいという基本的な感覚が依然として存在します。 それは大きな障害です。 おっしゃるとおり、規制に関しても雲行きが怪しくなっています。 ヨーロッパでモデルが重大な規制を受けると、入手できなくなる可能性もあります。 しばらくの間、ChatGPT がそこで削除されたのをすでに見てきました。 大企業が遵守するのが面倒だと判断した場合、その地域からサービスを撤退するだけかもしれません。

法的な側面もあります。 おっしゃるとおり、これらのモデルは、Web から収集した著作権で保護されたデータを含むデータに基づいています。 そのデータのプロバイダーが適切な償還を要求し始めれば、これらのモデルの将来の使用レベルにも影響します。 次にセキュリティ面です。 これらのモデルを攻撃などに対してどの程度安全にできるか。 ここを進むには間違いなく向かい風があります。

Q: 「人間関係者」についてよく聞きます。 生成 AI によって作成されたものを視聴者に公開する前に、人間によるレビューと承認が必要です。 しかし、genAI の利点の 1 つは、その創造性のスピードと規模です。 人間はどのようにして追いつくことができるのでしょうか?

A:スピードとスケールは、人間がやるべきことを行うために使用されるものです。 これは、たとえば、何かに対する答えを得るために 10 枚の文書に目を通す必要がある人々を支援するためにあります。 今では 1 分でそれができるようになりました。 信頼の問題があるため、これらは言語モデルを使用する最も価値のある種類のタスクです。

Q:責任ある AI が停滞状態から 5 ~ 10 年後だとすると、波乱万丈な道のりを予測しているように見えます。

A:規制の世界やその他のシステムは不明です。 そして、それらが正式に定められ、知られるようになったとしても、地域ごとに異なる規制が存在するでしょう。 これらのモデルの本質的な性質として、安全ではない傾向があります。 それをコントロールできるようになるには時間がかかります。 モデルが安全であることをどのように確認しますか? モデルのコンプライアンスをどのように監査しますか? セキュリティのためですか? ベストプラクティスを手に入れるのは困難です。 どの組織も独自のアプローチを採用しています。 生成 AI のことは忘れてください。他の AI モデル、組織によってしばらく使用されてきたモデルは、依然として間違いを犯しており、依然としてバイアスを示しています。

Q:人々は差し迫った幻滅の谷にどのように備えるべきでしょうか?

A:組織は生成 AI の経験においてさまざまな軌跡をたどることになるため、必ずしも組織が谷に陥る必要があるというわけではありません。 これは通常、期待に応えられなかったときに起こります。 いくつかの対象を絞ったユースケース、いくつかの対象を絞った実装部分に注目することから始め、成功のための適切な指標があり、データ管理と組織への投資も得ている場合。 良い統治、良い政策。 これらすべてを、モデルが何ができるかについての実践的な説明と組み合わせると、誇大広告を制御でき、谷に陥る可能性が低くなります。

Q: AI の誇大宣伝サイクルは、これまで見てきた他のものよりも速く進んでいると思いますか?

A: AI の誇大宣伝サイクルは、曲線をより速く通過するイノベーションに偏る傾向があります。また、できることにおいても、より大きな影響力を持つ傾向があります。 現時点では、VC にとって、これは資金調達イニシアチブの中心となっています。 研究分野においても、これは非常に注目されている分野です。 これらの多くは、この分野で非常に活発な学術界から生まれています。

Q:最後に、AGI、つまり汎用人工知能(人間の知能を複製するAI)についてです。 それは10年以上かかると考えられています。 まったく不可能かもしれないから、賭けをヘッジしていませんか?

A:はい。 「プラトーの前に廃止される」マーカーがあります。 実際にはそんなことは起こらないとする議論もありますが、AGI が実際に何であるかについては非常に多くの異なる解釈があるため、私たちはそれが 10 年以上かかると言っています。 多くの尊敬される研究者は、私たちはAGIに到達する道を進んでいると言っていますが、その道が実際にどのようなものであるかを確認するには、さらに多くの画期的な進歩と革新が必要です。 それは多くの人が信じているよりも遠い話だと私たちは考えています。

さらに深く掘り下げる: 最先端のマーテック ソリューションを無料で発見 – 来週オンラインで!

マーテックを手に入れましょう! 毎日。 無料。 受信箱にあります。

規約を参照してください。

関連記事

マーテックの新機能