Was hält die Zukunft für genAI bereit? Der Gartner-Hype-Zyklus

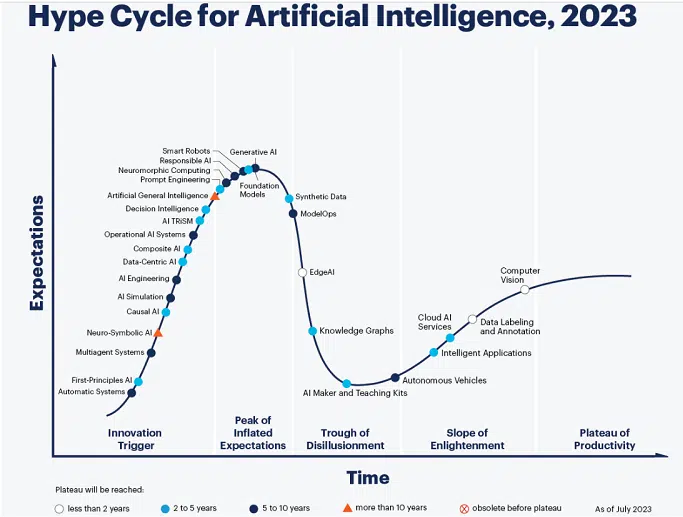

Veröffentlicht: 2023-09-21Es überrascht niemanden, dass generative KI und die grundlegenden Modelle, die sie unterstützen, derzeit ganz oben auf dem zu finden sind, was Gartner in der neuesten Ausgabe des „Gartner Hype Cycle for Artificial Intelligence“ als „Höhepunkt überhöhter Erwartungen“ bezeichnet. Das bedeutet, dass sie am Abgrund schwanken, der sie in den „Tal der Desillusionierung“ stürzen könnte.

Wir haben mit Afraz Jaffri, Chefanalyst bei Gartner mit Schwerpunkt auf Analytik, Datenwissenschaft und KI, darüber gesprochen, wie wir die Situation interpretieren sollten. Das Interview wurde aus Gründen der Länge und Klarheit bearbeitet.

F: Sie gehen davon aus, dass es zwei bis fünf Jahre dauern wird, bis die Grundlagenmodelle vorliegen, und fünf bis zehn Jahre, bis die generative KI das „Plateau der Produktivität“ erreicht. Worauf basiert das?

A: Hier können wir eine echte Akzeptanz beobachten, nicht nur bei einer ausgewählten Anzahl von Unternehmen, die wahrscheinlich viel schneller erfolgen wird, sondern bei allen Organisationsebenen – überwiegend in Form von Paketanwendungen. Jede Software wird über eine Art generative KI-Funktionalität verfügen, aber es wird länger dauern, bis die tatsächlichen Produktivitätssteigerungen durch diese Funktionen verstanden werden. Es ist ein Wettlauf für alle, ein generatives KI-Produkt oder eine generative KI-Funktion innerhalb ihrer Software bereitzustellen. In all diesen Fällen wird es länger dauern, bis die Vorteile zum Tragen kommen und auch gemessen werden.

Stiftungsmodelle decken ein breites Spektrum ab; nicht nur die großen Sprachmodelle, sondern auch Bild- und Videomodelle. Deshalb wird die Zeit bis zum Plateau länger sein. Es ist ein Eimer mit allen möglichen Modellen.

Erfahren Sie mehr: Warum uns KI im Marketing am Herzen liegt

F: Man kann sich Dinge vorstellen, die für die generative KI sehr störend sein könnten. Eine davon ist die Regulierung – es gibt vor allem in Europa echte Bedenken hinsichtlich der Ausbeutung personenbezogener Daten durch große Sprachmodelle. Der andere betrifft das Urheberrecht. Haben Sie solche möglichen Störungen hier berücksichtigt?

A: Ja, sie sind Teil des Denkens. Das erste Problem ist eigentlich der Vertrauensaspekt. Ungeachtet externer Vorschriften besteht immer noch die grundsätzliche Meinung, dass es sehr schwierig ist, die Ergebnisse der Modelle zu kontrollieren und sicherzustellen, dass die Ergebnisse tatsächlich korrekt sind. Das ist ein großes Hindernis. Wie Sie bereits erwähnt haben, gibt es auch eine Wolke rund um die Vorschriften. Wenn die Modelle in Europa einer erheblichen Regulierung unterliegen, sind sie möglicherweise nicht einmal verfügbar; Wir haben bereits seit einiger Zeit gesehen, dass ChatGPT dort entfernt wurde. Wenn die großen Unternehmen erkennen, dass die Einhaltung der Vorschriften zu aufwändig ist, ziehen sie möglicherweise einfach ihre Dienste aus dieser Region zurück.

Es gibt auch die rechtliche Seite. Diese Modelle basieren, wie Sie sagten, auf Daten, zu denen auch urheberrechtlich geschützte Daten aus dem Internet gehören. Wenn die Anbieter dieser Daten anfangen, eine entsprechende Entschädigung zu verlangen, hat das auch Auswirkungen auf die zukünftige Nutzung dieser Modelle. Dann ist da noch die Sicherheitsseite. Wie sicher kann man diese Modelle beispielsweise gegen Angriffe schützen? Hier gibt es auf jeden Fall etwas Gegenwind zum Navigieren.

F: Wir hören viel über den „Human-in-the-Loop“. Bevor Sie etwas, das durch generative KI erstellt wurde, einem Publikum zugänglich machen, müssen Sie eine menschliche Überprüfung und Genehmigung einholen. Aber einer der Vorteile von genAI ist die Geschwindigkeit und der Umfang seiner Kreativität. Wie kann der Mensch mithalten?

A: Die Geschwindigkeit und das Ausmaß sind dazu da, von Menschen genutzt zu werden, um die Dinge zu tun, die sie tun müssen. Es soll Menschen helfen, die beispielsweise zehn Dokumente durchgehen müssen, um eine Antwort auf eine Frage zu erhalten. Jetzt können sie es in einer Minute tun. Aufgrund des Vertrauensproblems sind dies die wertvollsten Aufgabentypen, für die ein Sprachmodell verwendet werden kann.

F: Wenn die verantwortungsvolle KI noch fünf bis zehn Jahre von ihrem Plateau entfernt ist, sehen Sie so aus, als würden Sie eine holprige Fahrt vorhersagen.

A: Die Regulierungswelt und andere Systeme sind unbekannt; und selbst wenn sie formalisiert und bekannt werden, wird es für verschiedene Regionen unterschiedliche Vorschriften geben. Die angeborene Natur dieser Modelle besteht darin, dass sie dazu neigen, nicht sicher zu sein. Es wird einige Zeit dauern, bis man das kontrollieren kann. Wie prüft man, ob ein Modell sicher ist? Wie prüfen Sie ein Modell auf Konformität? Aus Sicherheitsgründen? Best Practices sind schwer zu finden; Jede Organisation verfolgt ihren eigenen Ansatz. Vergessen Sie die generative KI. Andere KI-Modelle, die von Organisationen schon seit einiger Zeit verwendet werden, machen immer noch Fehler und weisen immer noch Vorurteile auf.

F: Wie sollten sich Menschen auf den drohenden Tiefpunkt der Ernüchterung vorbereiten?

A: Organisationen werden in ihrer Erfahrung mit generativer KI unterschiedliche Wege einschlagen, das bedeutet also nicht unbedingt, dass eine Organisation in die Talsohle fallen muss. Dies geschieht im Allgemeinen, wenn die Erwartungen nicht erfüllt werden. Wenn Sie sich zunächst einige gezielte Anwendungsfälle und einige gezielte Implementierungsteile ansehen und gute Erfolgskennzahlen sowie Investitionen in Datenmanagement und -organisation haben; gute Regierungsführung, gute Politik; Wenn Sie all das mit einer praktischen Erzählung darüber kombinieren, was die Modelle können, dann haben Sie den Hype unter Kontrolle und werden weniger wahrscheinlich in die Talsohle fallen.

F: Würden Sie sagen, dass der KI-Hype-Zyklus schneller abläuft als andere, die Sie sich angesehen haben?

A: Der KI-Hype-Zyklus weist tendenziell eine Tendenz zu Innovationen auf, die sich schneller entwickeln – und sie sind in der Regel auch wirkungsvoller in dem, was sie bewirken können. Im Moment steht es im Mittelpunkt von Finanzierungsinitiativen für VCs. Es ist ein so zentraler Bereich, auch im Forschungsbereich. Vieles davon kommt aus der Wissenschaft, die in diesem Bereich sehr aktiv ist.

F: Schließlich AGI oder künstliche allgemeine Intelligenz (KI, die menschliche Intelligenz nachbildet). Sie gehen davon aus, dass das in zehn Jahren oder länger der Fall sein wird. Sichern Sie Ihre Wetten ab, weil es vielleicht gar nicht möglich ist?

A: Ja. Wir haben eine Markierung, die „veraltet vor dem Plateau“ ist. Es gibt Argumente dafür, dass es nie wirklich passieren wird, aber wir sagen, dass es mehr als 10 Jahre dauern wird, weil es so viele verschiedene Interpretationen davon gibt, was AGI eigentlich ist. Viele angesehene Forscher sagen, dass wir auf dem Weg sind, der uns zu AGI führt, aber es sind noch viele weitere Durchbrüche und Innovationen erforderlich, um zu sehen, wie der Weg tatsächlich aussieht. Wir glauben, dass es etwas ist, das weiter entfernt liegt, als viele Leute glauben.

Tauchen Sie tiefer ein: Entdecken Sie modernste Martech-Lösungen kostenlos – nächste Woche online!

Holen Sie sich MarTech! Täglich. Frei. In Ihrem Posteingang.

Siehe Bedingungen.

Ähnliche Beiträge

Neu bei MarTech